顶刊 Cell 封面重磅突破!首次实现机器人-作物授粉全流程自动化,成功率接近100%!

目录

授粉——自然界中精妙的生命协作,却成了农业智能化的 “头等难题”:传统作物的花柱深藏于花瓣间,机器人难以精准触碰,人工杂交授粉不仅耗时耗力,还严重限制了育种效率。

由中科院遗传发育所、自动化所联合上海交大、清华大学等团队发表在顶刊《Cell》上的这项研究,提出了 “作物 - 机器人协同设计” 的颠覆性范式,更通过基因编辑改造花形态、结合具身智能机器人实现自动化杂交授粉。

首次让农业从 “人工依赖” 真正迈向 “智能自主育种”,为精准农业突破瓶颈提供了可落地的革命性方案。

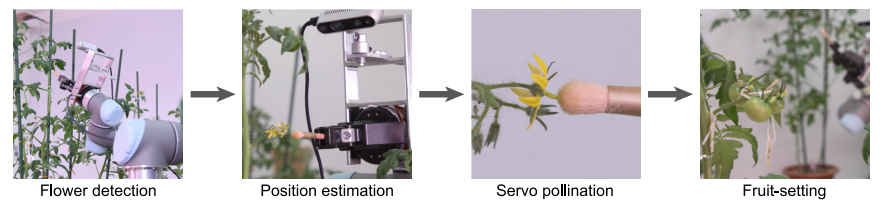

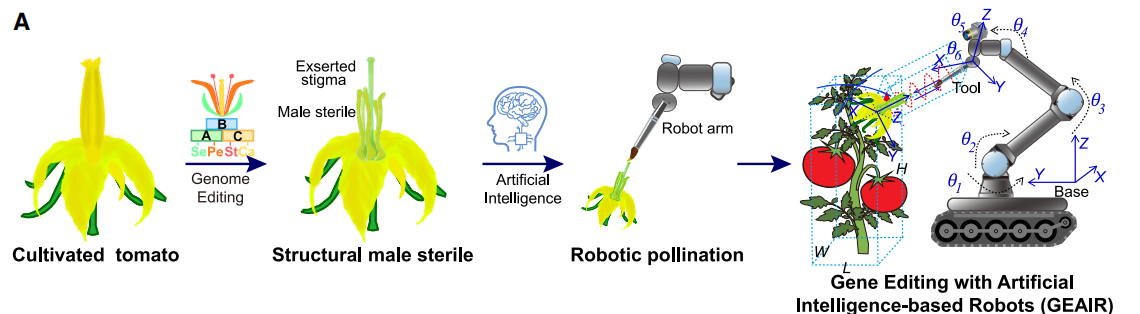

▲图1|机器人授粉过程全链路演示

01 从基因编辑到机器人授粉

研究团队发现,传统作物的花柱常常被花瓣包裹,机器人的摄像头和机械臂难以准确识别与接触目标位置。他们的关键洞察在于:授粉难题不只是算法问题,而是植物形态与机器人动作的双向错配。于是,研究者提出了 GEAIR(Genome Editing + AI-based Robotics) 系统。

他们首先利用 CRISPR 基因编辑技术,调控番茄的 GLO2 基因,让花柱从花冠中伸出,形成“对机器人友好”的形态。

随后,他们设计了一套智能授粉机器人系统:

● 机械结构:UR5机械臂 + Robotiq夹爪 + RealSense D435i相机 + 软毛刷;

● 感知系统:基于 YOLACT_Orient 深度学习模型 的花朵检测与姿态估计;

● 触觉识别:利用 Inception-v3 网络 判断刷子是否与花柱成功接触。

最终,机器人不仅能“看见花”,还能“理解花”——判断其方向、距离与接触状态,完成精准授粉操作。

02 技术亮点

感知-物理融合的具身感知系统

在自然授粉中,昆虫依靠触觉来判断花粉是否接触成功。而 GEAIR 机器人试图让机器拥有类似的“触觉本能”。

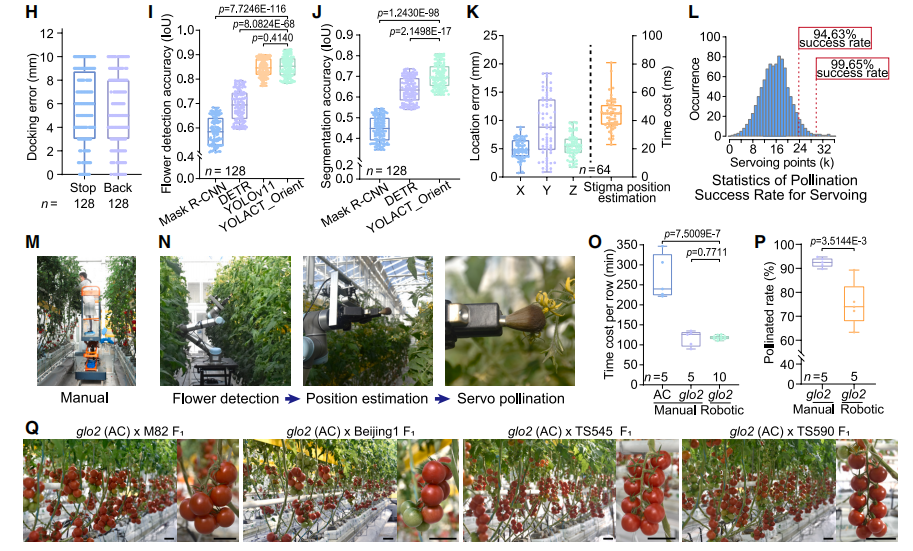

研究团队为此在机械臂末端装配了软毛刷式工具(soft brush end-effector),并配合高精度RGB-D相机(RealSense D435i)采集花朵结构与姿态信息。视觉部分由改进的 YOLACT_Orient 模型负责检测花朵区域与花柱朝向,其检测精度(mAP 85.1%)显著优于 Mask R-CNN(79.3%)与 DETR(81.7%),在复杂光照与花瓣重叠的情况下依然保持稳定识别。

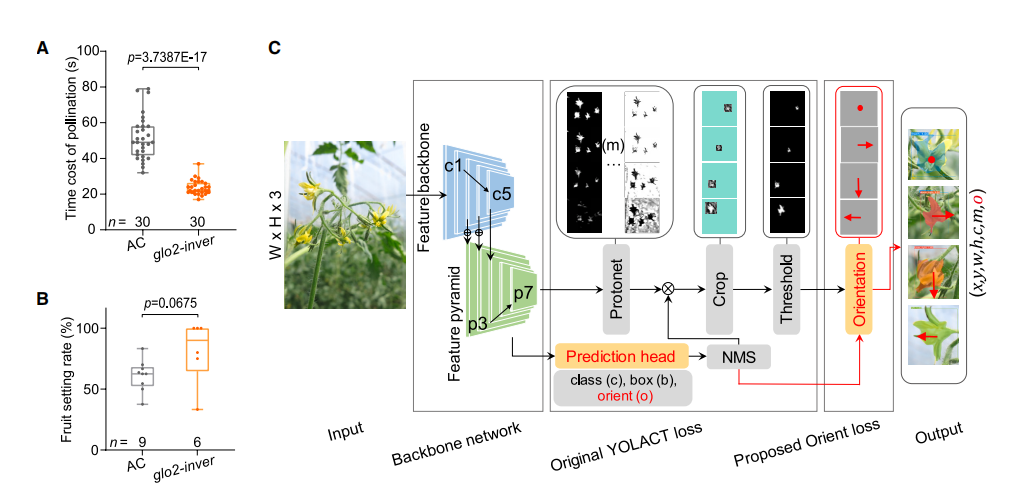

▲图2|深度学习赋能花朵检测与花柱定位这一部分展示了机器人“看懂花”的全过程。(A)(B):人工授粉与机器人授粉在时间和结实率上的对比。研究者选取了3位经验丰富的操作者进行对照,结果显示,机器人在效率和稳定性上都具备竞争力。(C):YOLACT_Orient 模型的检测流程示意。输入图像被统一为 550 像素分辨率,网络输出花朵置信度、边界框位置、实例分割掩码和花柱朝向参数。通过这一步,机器人不只是识别“哪儿有花”,还能理解“花朝哪边开”

感知仅仅“看到”还不够。研究者进一步在机器人控制回路中引入触觉状态识别模块,利用 Inception-v3 神经网络分析来自摄像头的花粉刷接触图像,以区分“已接触”和“未接触”两种状态。该模块在320次实验中成功率高达 99.68%,几乎实现零误判。

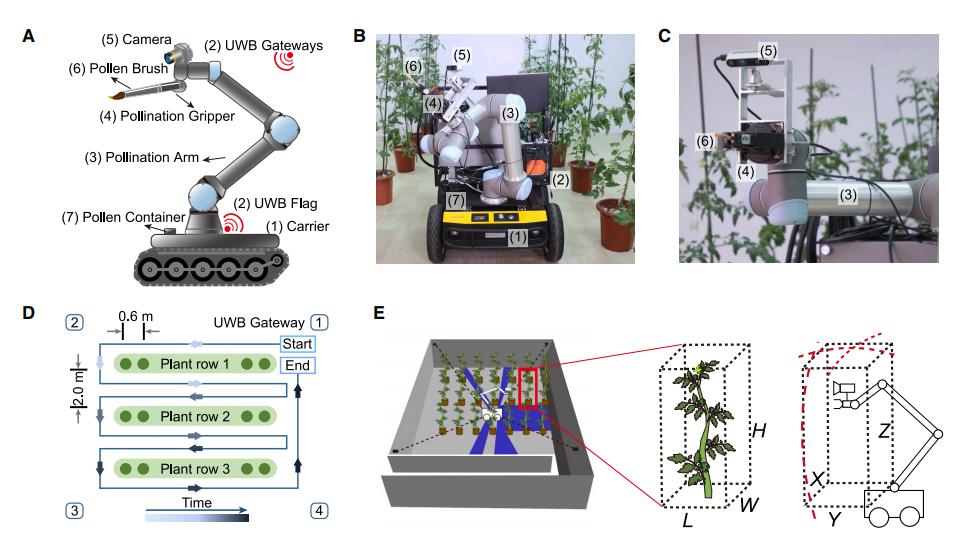

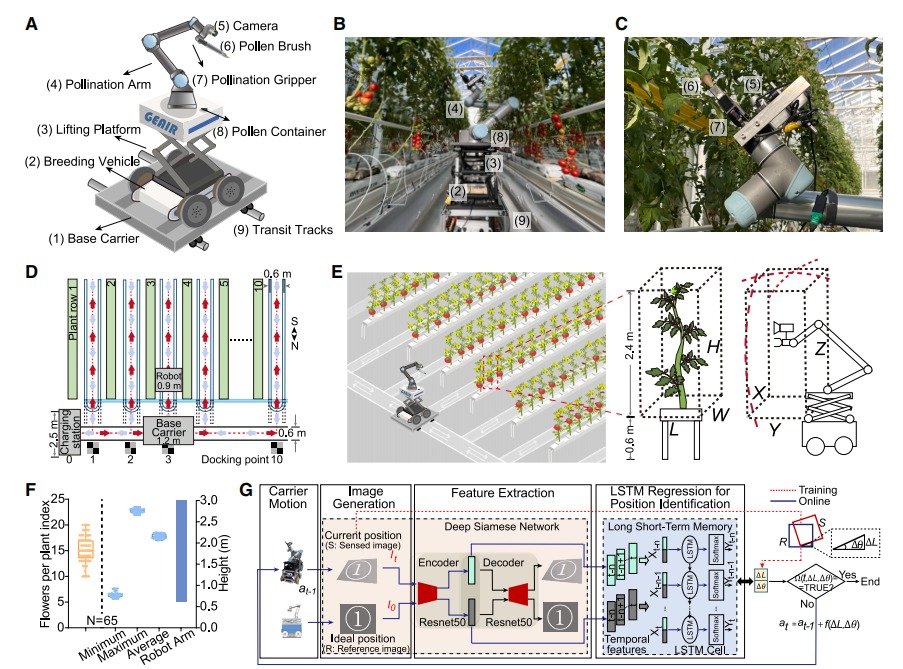

▲图3|这一组图展示了授粉机器人的软硬件组成与全流程作业方式。(A–C):机器人结构与实物图,包括 UR5 机械臂、摄像头与末端软毛刷。(D–E):温室中的植物布局与导航路线规划。浅绿色矩形代表植株范围,深绿色圆点是花位坐标,深蓝线为机器人轨迹

通过这种视觉—触觉的融合感知,机器人能主动修正机械臂末端的运动轨迹,确保花粉传递动作的物理正确性。这种设计的核心价值在于:它不是单纯的“图像识别”,而是实现了具身层面的感知—交互闭环。机器人不再只是远距离观察者,而能通过实际触碰与环境互动获取反馈。这种主动感知机制,为具身智能在自然生态任务(如采摘、护理、授粉)中的精细操作提供了范例。

▲图4|机器人授粉过程的细节展示

作物-机器人协同设计(Co-Design)理念

GEAIR 的真正突破点不在算法,而在理念——它首次让作物和机器人共同参与设计过程。

传统的农业自动化常常从机器出发,试图让算法适应自然界千变万化的结构。但团队敏锐地意识到:有时,不如让生物形态本身更友好地服务于智能体的动作结构。

研究者通过对番茄 GLO2 基因的精准编辑,使花柱从花冠中外露(stigma exsertion phenotype),并结合 MS10 基因构建出雄性不育系。这样一来,机器人无需复杂的深度探测即可直接定位花柱,极大简化了视觉识别和路径规划难度。这不仅减少了感知误差累积,也显著提升了授粉成功率。

▲图5|研究团队提出了 GEAIR(Genome Editing + AI-based Robotics)策略,通过基因编辑优化花部结构,让机器人更容易识别与操作。图中展示了花朵的主要组成部分:萼片(Se)、花瓣(Pe)、雄蕊(St)和心皮(Ca)。经过 GLO2 基因调控后,花柱伸出花冠,为机械臂的精准授粉提供了“入口”。这一步,奠定了“让作物为机器人设计”的全新思路

更值得注意的是,这种“可机器人操作化的花型”并未影响植物的自然生长与结实率。论文报告显示,经 GEAIR 授粉后的结实率为 74.6% ± 10.7%,与人工授粉(85.3% ± 22.2%)差距不大,但稳定性更高。这意味着作物结构优化不仅可行,而且可量产化,为“可机械操作作物(robot-operable crops)”这一新概念奠定了基础。

这种跨越基因编辑与机器人控制的“双向优化”思路,代表了具身智能研究的一种新方向:不再让智能体被动适应世界,而是让世界也为智能体重新定义。 在未来,这种 co-design 思维或许会扩展到更多领域,从农作物到建筑再到医疗器械,构建出真正的“协同具身生态系统”。

全链路自主系统:从导航到交互的真实具身闭环

GEAIR 机器人不仅是实验室里的机械臂,而是一套端到端、全链路自主系统。它包括底盘移动、视觉定位、路径规划、机械臂控制和授粉执行五个环节,实现了从“看到花”到“完成授粉”的全流程闭环。

在底盘层面,系统采用 ShiHe MR1000 移动平台,结合 UWB 定位模块与 STL 地图导航,在温室轨道间自动行驶,定位误差小于 10 cm。

机器人通过激光测距与视觉融合定位判断当前行进区间,一旦进入目标花区,自动抬升至预设高度,机械臂展开授粉动作。所有操作均可在温室环境中连续执行,具备工业级稳定性。控制层面,UR5机械臂与 Robotiq F85 夹爪组合提供六自由度操作空间。团队设计的运动规划算法基于动态姿态补偿策略,使机械臂在风动、花枝摇摆等扰动下依然保持精准控制。整个过程由中央控制器调度,授粉完成后,系统自动返回基座,准备下一个周期。

更重要的是,这套系统已在北京近郊商业温室完成多轮实测,连续工作数小时无中断。这标志着 GEAIR 并非停留在概念验证阶段,而是真正迈出了具身智能从实验走向真实农业环境的关键一步。

▲图6|这组图记录了机器人在北京近郊商业温室的真实部署。(A–C):从结构示意到现场实拍,展示了机器人如何在轨道上自动移动并完成授粉操作。(D–E):温室中番茄植株的分布与机器人臂的工作范围。三维参数(W、L、H 对应植株空间;X、Y、Z 对应机械臂运动空间)体现了系统的全域覆盖能力

03 实验

在北京近郊的商业温室里,这套机器人系统完成了多轮实地验证。

机器人可在温室轨道上自动往返作业,识别花朵、伸臂接触、完成授粉,全流程无需人工干预。结果显示:

● 机器人授粉的结实率达 74.6% ± 10.7%;

● 与人工授粉(85.3% ± 22.2%)相当,但波动更小,稳定性更高;

● 系统可连续作业数小时,并显著减少人力投入。

从图表可以看出,机器人在真实复杂光照与花型环境中依然保持高识别与操作精度,证明了这一具身协同系统在现实农业场景下的可行性与鲁棒性

▲图7|这组图记录了机器人在北京近郊商业温室的真实部署。(H):机器人通过 DSN + LSTM 模型进行基座精准对接,前后运行误差均保持在极低水平。(I–K):不同模型在花朵检测与分割精度上的对比,YOLACT_Orient 显著领先;花柱定位误差和时间开销的量化分析则展示了系统的实时性。(L–N):960 次授粉实验的伺服点分布,以及人工与机器人授粉的现场对比。(O–P):时间成本与授粉成功率的系统对比,机器人在连续作业中的效率优势清晰可见。(Q):温室中长出的第一批 F1 杂交植株,代表了从算法到生物学的完整闭环成果

04 总结

这项 Cell 工作不仅仅是一次农业自动化的突破,更是具身智能的一次“生态重构”。

它打破了“智能只存在于机器人”的传统思维,将生物体与机器体纳入同一系统设计范式。

当机器人能在自然生态中与生命互动、共生——那才是具身智能的真正边界。或许未来,我们不只在让机器人更聪明,也在让世界更可理解。当机器人学会“理解花”,也许距离“理解世界”,就不再遥远

原文链接:https://www.sciencedirect.com/science/article/pii/S0092867425008402

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)