收藏 | 具身智能世界模型:小白也能懂的AI前沿技术入门指南

本文深入浅出地介绍了具身智能领域中的世界模型,对比了VLA与世界模型决策的异同。世界模型主要用于训练阶段,通过合成机器人轨迹数据、模拟任务动态、评估策略等,有效降低计算资源消耗。文章还详细阐述了世界模型的四大用途、技术架构分类、不同时间建模和空间表示方法,并重点介绍了蚂蚁集团推出的LingBot-World和LingBot-VA模型及其技术特点。最后,文章探讨了世界模型的评价尺度及当前面临的挑战,

本文深入浅出地介绍了具身智能领域中的世界模型,对比了VLA与世界模型决策的异同。世界模型主要用于训练阶段,通过合成机器人轨迹数据、模拟任务动态、评估策略等,有效降低计算资源消耗。文章还详细阐述了世界模型的四大用途、技术架构分类、不同时间建模和空间表示方法,并重点介绍了蚂蚁集团推出的LingBot-World和LingBot-VA模型及其技术特点。最后,文章探讨了世界模型的评价尺度及当前面临的挑战,指出其成熟度仍较低,主要应用于训练辅助。

和智能驾驶一样,具身智能领域的世界模型也很火爆,二者高度重叠,不过还是有所差别。

VLA与世界模型决策的区别

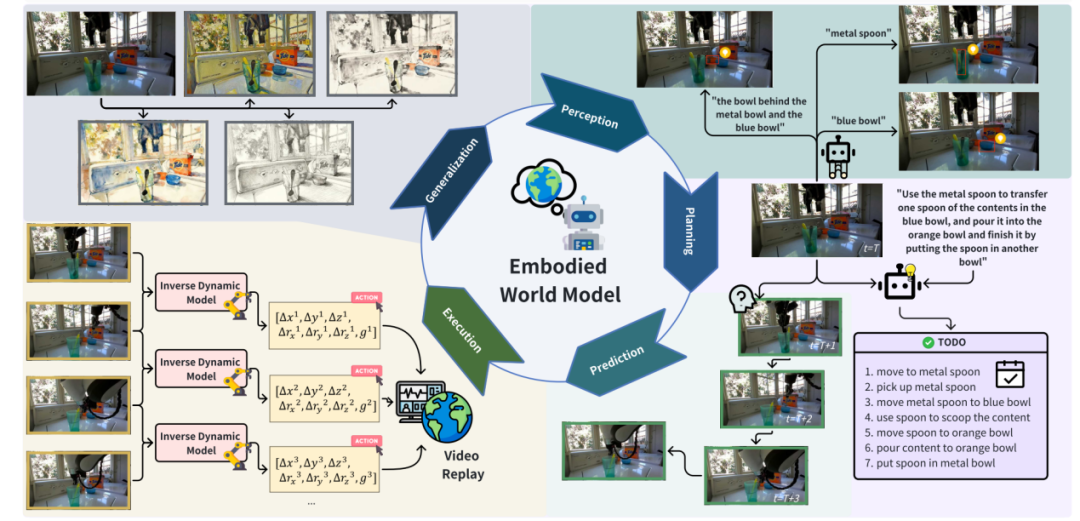

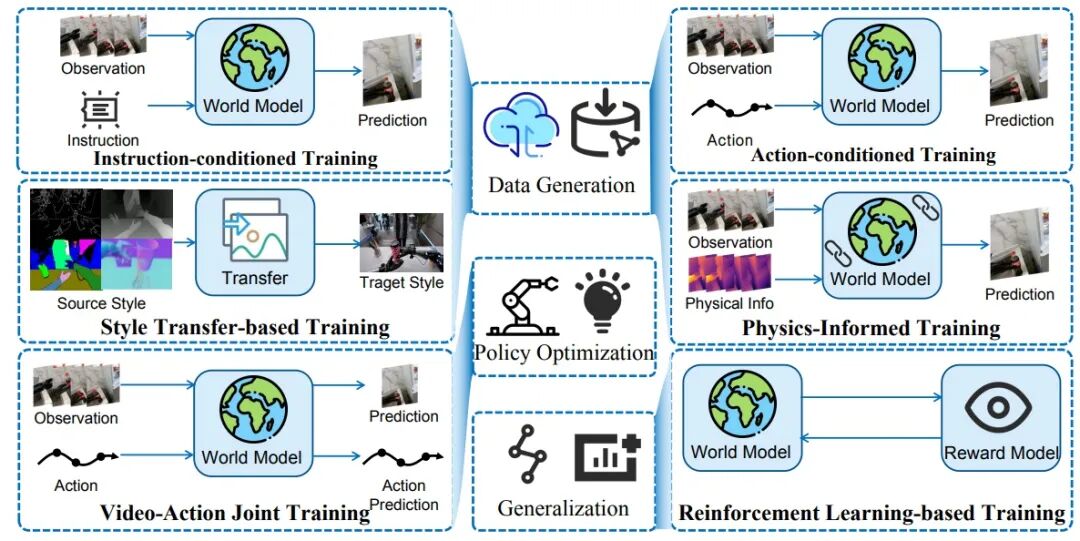

图片来源:论文《A Survey of Embodied World Models》

VLA与世界模型决策的区别在于,VLA的核心是LLM,通常规模都比较大,参数在40-100亿之间,典型参数大多是70亿,世界模型则小得多,典型参数约3-4亿,小的可以只有几千万,这样所消耗的计算资源就降低50%以上。

具身智能领域,世界模型更多是服务于训练阶段,一方面,它能合成机器人轨迹数据,替代耗时耗力的人类遥操作数据采集;另一方面,通过模拟任务动态与预测未来状态,可为机器人策略(Policy)学习提供高效支持。再一方面,作为环境代理,在仿真系统中评估与训练具身智能体;最后则是作为机器人的“大脑”,通过实时状态推理支持行动决策。

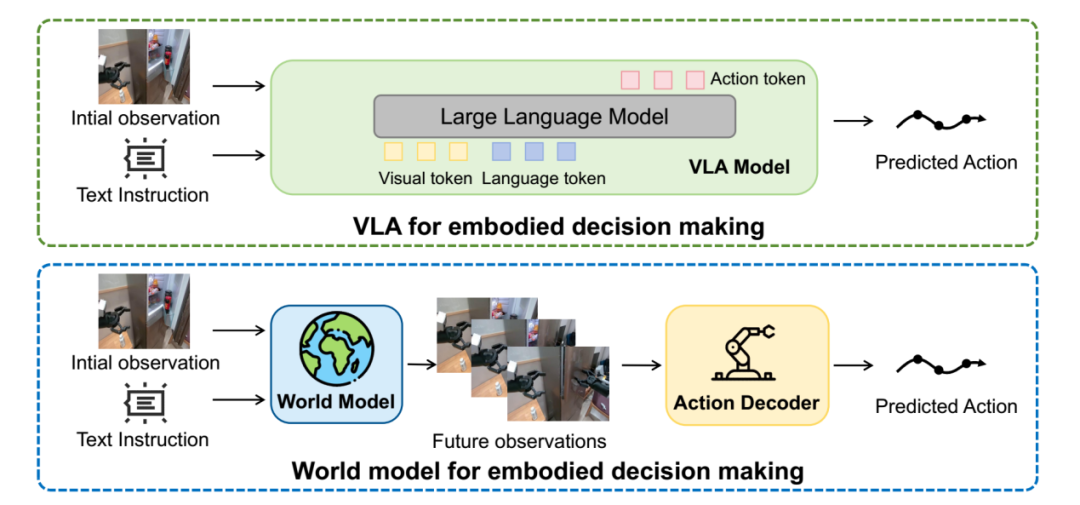

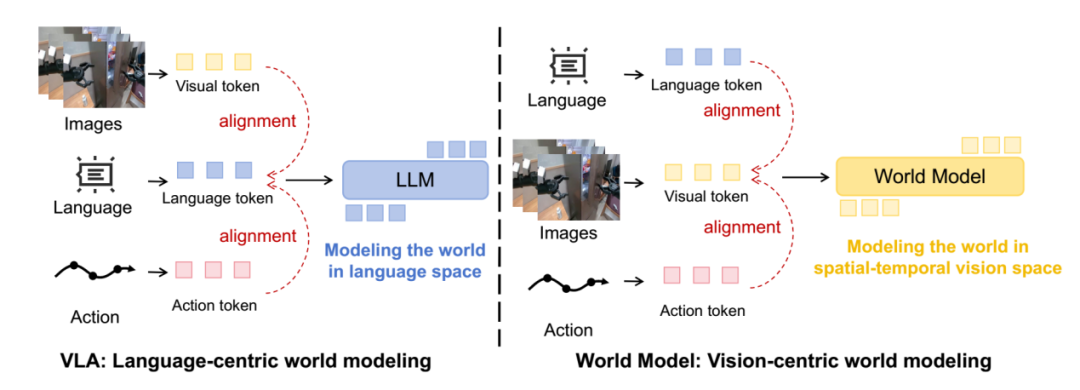

VLA与世界模型对比

图片来源:论文《A Survey of Embodied World Models》

具身智能领域,机器人要接收来自人类的语言指令,VLA模式的优势非常明显,VLA是绝对主流,世界模型一般只做训练辅助,直接做决策的非常罕见。智能驾驶不一样,语言不是核心,视觉是核心,世界模型直接做决策是研究热点。

图片来源:论文《A Survey of Embodied World Models》

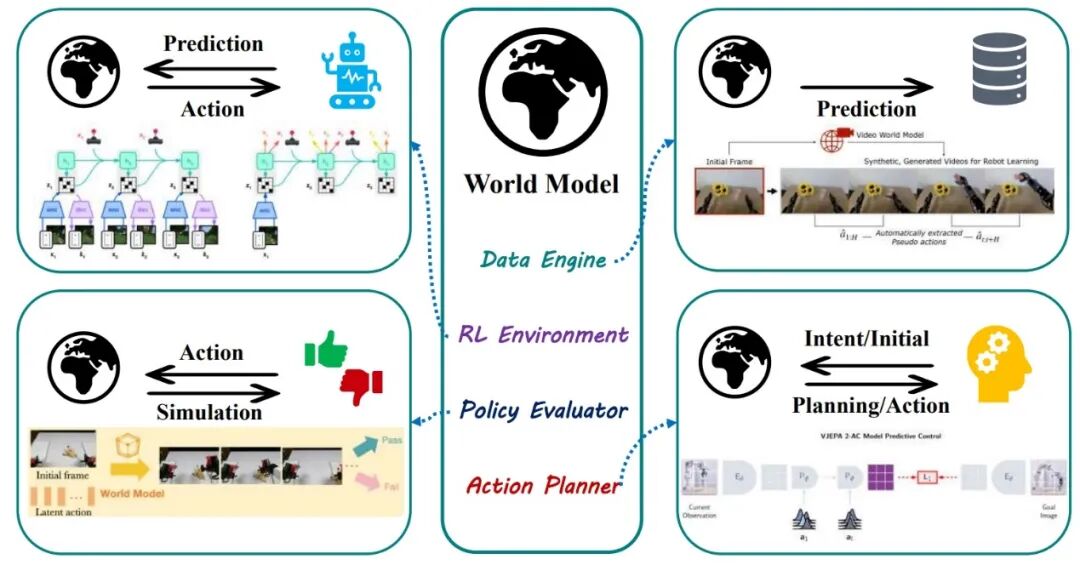

具身智能世界模型四大用途,分别是数据引擎,强化学习环境模拟优化策略,策略仿真评估,动作规划器。

图片来源:论文《A Survey of Embodied World Models》

世界模型用途也可以总结为三类:数据生成,策略优化和泛化。

在技术架构方面,现有具身世界模型可分为三类:①基于视频生成的世界模型、②融合三维重建的世界模型,和③以压缩表征为核心的潜在世界模型。训练方法多采用以外部指令(如文本指令或动作轨迹)为控制条件的生成范式。近年来,视觉-动作联合预测框架Video-Action World Model与物理约束学习机制等新范式也逐渐兴起,进一步提升了模型的动作理解能力与物理一致性。

按功能分,可以分为决策耦合型(Decision-Coupled):针对特定任务优化动态模型,与决策过程紧密绑定。这类模型通常与强化学习(RL)紧密结合,用于策略优化。通用型(General-Purpose):不针对特定任务,而是学习通用的环境动态,适用于多种下游应用。

按时间建模(Temporal Modeling)分,顺序模拟与推理(Sequential Simulation and Inference):以自回归方式逐步展开未来状态,适合长时域预测但易积累误差。全局差异预测(Global Difference Prediction):并行预测整个未来状态,效率更高但可能牺牲时间连贯性。

按空间表示(Spatial Representation)分为四类,①全局潜在向量(Global Latent Vector):将复杂状态编码为紧凑向量,计算效率高。②令牌特征序列(Token Feature Sequence):将状态建模为令牌序列,捕捉复杂依赖关系。③空间潜在网格(Spatial Latent Grid):利用几何先验(如鸟瞰图或体素网格)进行空间编码。④分解渲染表示(Decomposed Rendering Representation):将场景分解为可渲染的原始元素(如3D高斯溅射或神经辐射场NeRF),支持高保真度预测。

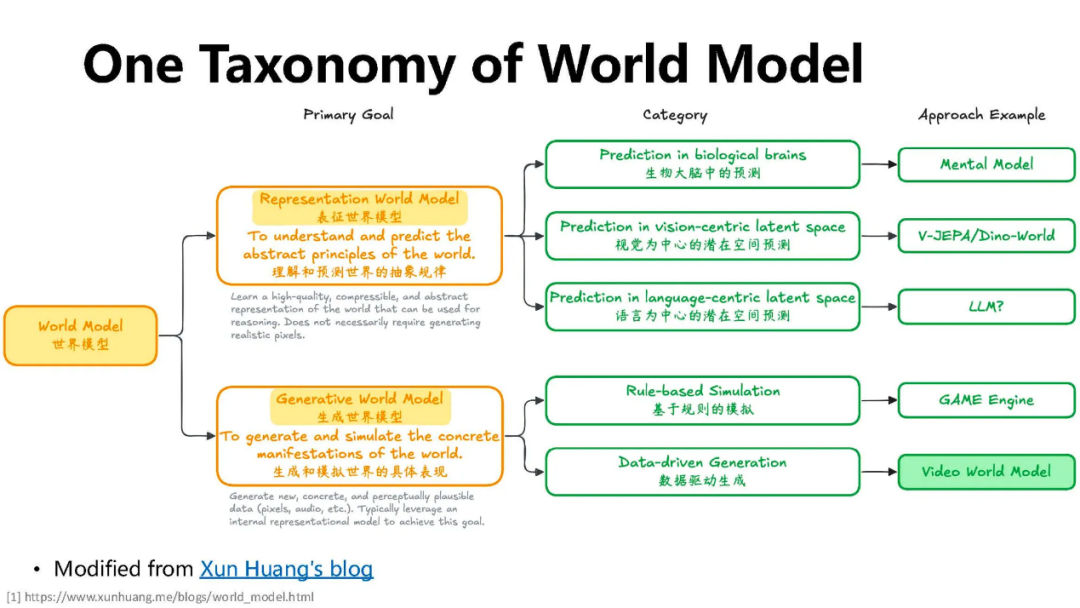

还有一种分类,按表征分,抽象表征 (Abstract representation): 就像我们大脑想象未来一样,它可能是一些概念、关系或物理量的抽象描述。想象打台球,你需要预测母球撞击目标球后,两颗球各自的运动轨迹。大脑中那个进行“预演”和“推算”的过程,就是一个内在的世界模型。又好比开车,你要让车实现某种轨迹,需要在大脑中推算方向盘转动幅度和速度控制。近似于物理世界,具象表征 (Concrete representation): 就像视频模型生成下一帧画面一样,它可能是对世界细节的像素级描绘。

视频生成换一种说法就是顺序模拟与推理(Sequential Simulation and Inference):以自回归方式逐步展开未来状态,适合长时域预测但易积累误差。优势:时序因果一致,适合闭环控制,纹理特征好,细粒度。局限性:长时预测需多次迭代,容易误差累计,串行流程,并行性较差,不适合GPU。

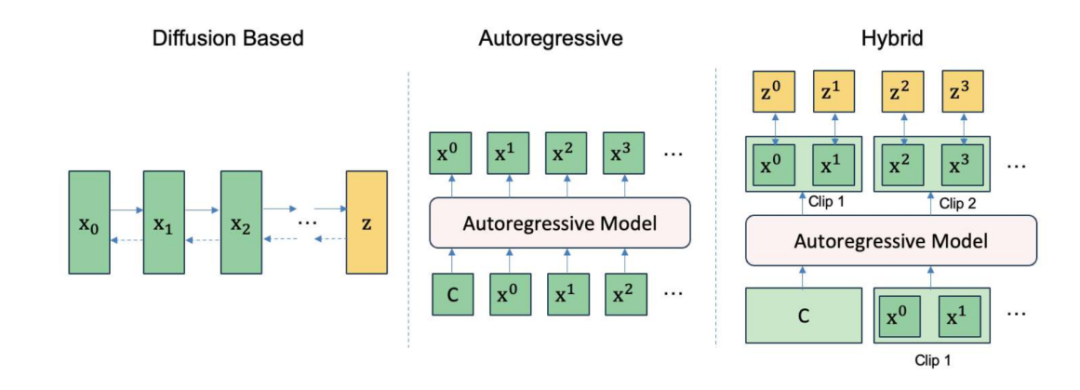

三种常见视频生成

图片来源:网络

三种常见视频生成,包括基于扩散,基于自回归和混合模式。目前混合模式是主流,能够生成视频比较长,可以达到分钟级;基于扩散模式,难以用GPU并行加速,通常生成视频较短,数秒乃至数十秒,但保真度比较高;自回归模式则相反,相对容易用GPU加速,保真度略低。

全局差异预测更接近于抽象表征,当然不仅限于抽象表征。并行地预测整段未来序列的时间建模方式。常见做法包括掩码/JEPA的特征预测与并行扩散视频生成,将未来时空区域作为整体目标,直接在潜空间中恢复或合成。优势:降低误差累积,并行计算效率高,便于添加全局约束。局限性:闭环交互性较弱,粗粒度,局部细节不足,可能缺乏纹理特征,可能出现空洞。全局差异预测再细分为令牌特征序列、潜在空间网格和分解渲染三大类。

- 令牌特征序列(Token Feature Sequence),典型代表有V-JEPA:通过预测遮挡时空区域的潜在特征,学习可泛化的外观和运动表示。WorldDreamer:将世界建模视为掩码视觉序列预测任务,用于多样化的视频生成和编辑。MaskGWM:结合扩散模型和掩码特征重建,提升长时域一致性。

- 空间潜在网格(Spatial Latent Grid),基本都是用于自动驾驶领域,几乎看不到具身智能领域有应用。典型代表即华为和浙大的OccWorld:预测 3D 占有率,支持自动驾驶中的运动规划。DriveWorld:将 RSSM 动态应用于鸟瞰图(BEV)令牌,支持联合预测和轨迹解码。OccLLaMA:将占有率、动作和文本统一到单个词汇表中,使用 LLaMA 进行预测、规划和问答。

- 分解渲染表示(Decomposed Rendering Representation),也是主要用于自动驾驶领域,典型代表DriveDreamer4D:结合复杂驾驶轨迹引导视频合成,优化4D高斯溅射(4DGS)模型。ReconDreamer:引入在线恢复模块,纠正高斯渲染视图中的伪影。MagicDrive3D:生成多视图街景,支持从BEV地图、3D框和文本到完整3D环境的转换。

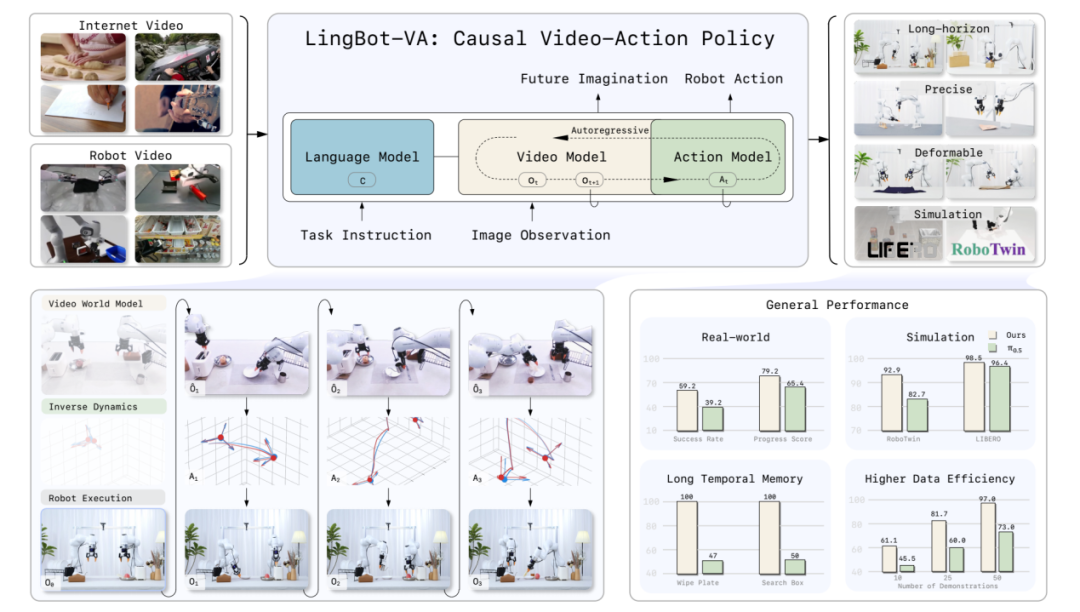

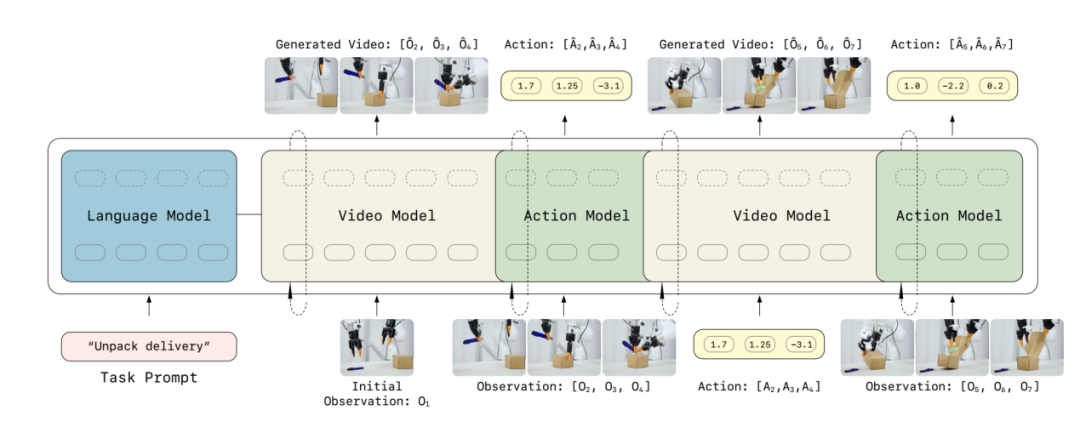

具身智能领域,自回归或混合模式生成视频是主流,并且针对全局性不足或缺乏真实物理世界因果推论能力,也有很多办法增强,目前巅峰的具身智能世界模型是蚂蚁集团(没错,就是支付宝母公司)旗下蚂蚁灵波刚刚推出的LingBot-World,2016年1月底,蚂蚁灵波一口气推出四个技术成就,瞬间就站上具身智能的巅峰。第一个发布的LingBot-Depth 模型,提供高精度的空间感知能力,让机器人真正"看清"物理世界;VLA 是具身操作的主流路线,灵波打造LingBot-VLA 基模并开源开放,在Depth的赋能下实现精准的物理操作,且具备突出的跨本体、跨任务的泛化能力。而LingBot-World则是构建了模拟的仿真空间,让它得以成为大脑的虚拟训练场;LingBot-VA则探索了模型与环境交互新范式,降低模型对环境的学习成本,提高了环境反馈的效率,为机器人基础模型从“反应式控制”走向“可推演、可闭环的行动生成”提供了可验证的技术选项。LingBot-VA实际也是个巅峰级的世界模型。

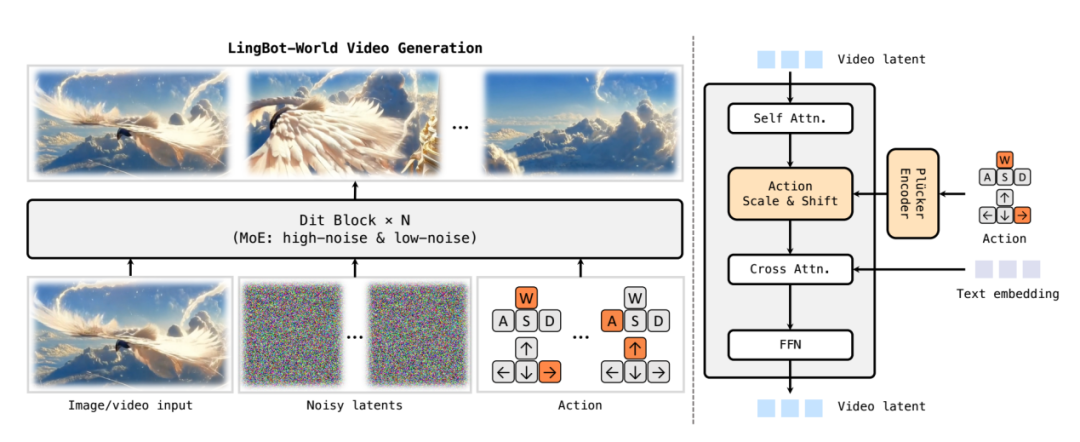

LingBot-World管线

图片来源:论文《Advancing Open-source World Models》

LingBot-World认为,如果要从视频生成转变成世界模型,这背后至少有三个瓶颈:①高质量交互数据稀缺、②标准扩散架构难以维持较长时间的叙事和结构的一致性、③传统模式的计算开销巨大。

蚂蚁灵波将他们的数据引擎分成了三个协同组件:数据获取、数据剖析、数据标注。数据主要来自于真实世界视频、游戏视频以及利用虚幻引擎制作的合成渲染数据。再利用一套标注流程,将数据转化成可训练的资产。训练也分层,先用通用视频来训练,即建设视频生成的基本能力(establish the general video prior),从而保证模型的高保真纹理等能力。接下来引入MoE架构,注入世界知识和动作可控制性。这样模型就具备了基本的世界知识。最后,加入实时推理架构。采用因果注意力适配和少步蒸馏,将双向扩散模型转换为高效的自回归系统。

LingBot-VA架构

图片来源:论文《Causal World Modeling for Robot Control》

LingBot-VA的MoT(Mix-of-Transformer)架构

图片来源:网络

在MoT架构中,一边是Transformer生成的视频流,另一边是Transformer生成的动作流。将两个"流"在序列中交错排列,便将高维视频 Token 与低维动作 Token 映射到了统一的潜空间里。LingBot-VA还会给模型加入注意力掩码机制,从而保证这套系统的预测是真的由自回归系统的预测得出的,而不是模型自己生成的。

蚂蚁灵波两个世界模型的缺点是参数太大,消耗资源太多,和JEPA这种抽象表征为核心的世界模型比大太多了。LingBot-World的总参数是280亿,两个专家模型。LingBot-VA采用阿里集团的通义万相2.2-Animate做骨干,参数有50亿,附加MoT参数3.5亿。

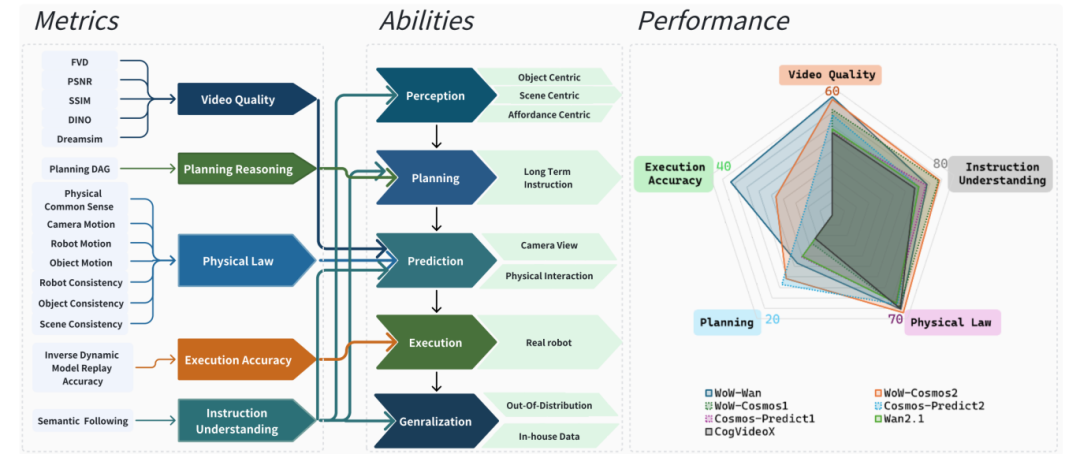

世界模型评价尺度和典型具身智能世界模型性能对比

图片来源:论文《Wow, wo, val! A Comprehensive Embodied World Model Evaluation Turing Test》

像素预测质量评估模型重建感官输入和生成真实序列的能力,主要关注图像保真度、时间一致性和感知相似性。

- Fréchet Inception Distance (FID) :比较真实和生成图像分布的相似性,值越低表示分布越接近。

- Fréchet Video Distance (FVD) :扩展 FID 到视频,评估每帧质量和时间一致性。

- Structural Similarity Index Measure (SSIM) :比较生成图像与参考图像的亮度、对比度和结构相似性。

- Peak Signal-to-Noise Ratio (PSNR) :衡量重建图像与参考图像之间的像素失真。

- Learned Perceptual Image Patch Similarity (LPIPS) :通过比较预训练网络提取的特征来衡量图像相似性。

- VBench:综合评估视频生成性能,涵盖视频质量和视频条件一致性。

- 2D平面状态/语义一致性:评估模型是否理解了场景的结构和语义。如自动驾驶感知领域常用的mIoU平均交并比、mAP平均准确度、Displacement Error、CD(点云结构相似度量)。

新近的评测倾向于设计诸如物理合规性、因果一致性等指标来弥补传统指标的不足。比如DMC,RLbench.

目前世界模型成熟度很低,学习效率极低,只能做训练辅助,同时世界模型在序列自回归和全局并行两种时间建模、不同空间表示之间难以找到平衡点,这就导致必然会在抽象表征和具象表征之间选边站,难以成为具身智能主流。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。我们整理出这套 AI 大模型突围资料包:

- ✅ 从零到一的 AI 学习路径图

- ✅ 大模型调优实战手册(附医疗/金融等大厂真实案例)

- ✅ 百度/阿里专家闭门录播课

- ✅ 大模型当下最新行业报告

- ✅ 真实大厂面试真题

- ✅ 2026 最新岗位需求图谱

所有资料 ⚡️ ,朋友们如果有需要 《AI大模型入门+进阶学习资源包》,下方扫码获取~

① 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

② 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。这里我给大家准备了一份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

③ 大模型学习书籍&文档

学习AI大模型离不开书籍文档,我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

④ AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

⑤ 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

⑥ 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

以上资料如何领取?

为什么大家都在学大模型?

最近科技巨头英特尔宣布裁员2万人,传统岗位不断缩减,但AI相关技术岗疯狂扩招,有3-5年经验,大厂薪资就能给到50K*20薪!

不出1年,“有AI项目经验”将成为投递简历的门槛。

风口之下,与其像“温水煮青蛙”一样坐等被行业淘汰,不如先人一步,掌握AI大模型原理+应用技术+项目实操经验,“顺风”翻盘!

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

以上全套大模型资料如何领取?

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)