盘点 | 2026顶会顶刊机器人触觉:聚焦五条技术主线

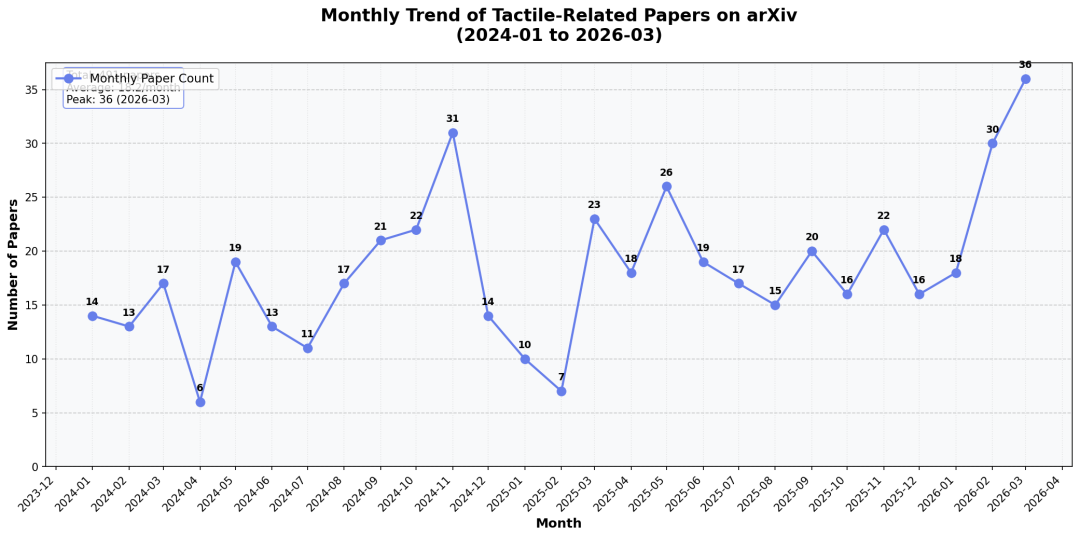

随着具身智能对物理世界交互精度的要求持续提升,触觉感知正从单一模态的信号获取,转向多任务泛化、动态闭环与结构仿生的系统性技术突破。这些工作共同指向一个核心方向——触觉正从“传感器数据采集”走向“面向动态交互的智能表征与闭环控制”。2026年以来,与触觉相关的研究逐月升高。发文团队。

2026年顶会顶刊释放的五大「触觉」关键信号

——从静态识别到动态闭环

目录

ICRA2026 | A Closed-Loop CPR Training Glove with Integrated Tactile Sensing and Haptic Feedback

RAL2026 | Simultaneous Extrinsic Contact and In-Hand Pose Estimation via Distributed Tactile Sensing

随着具身智能对物理世界交互精度的要求持续提升,触觉感知正从单一模态的信号获取,转向多任务泛化、动态闭环与结构仿生的系统性技术突破。

近期在ICRA、ICLR、RAL等顶会顶刊上,触觉相关研究呈现出鲜明的新趋势:

小样本识别、闭环反馈、动态表征、VR 仿真、姿态 - 接触联合估计……

这些工作共同指向一个核心方向——触觉正从“传感器数据采集”走向“面向动态交互的智能表征与闭环控制”。

2026年以来,与触觉相关的研究逐月升高。

本文将重点梳理触觉这一领域的最新研究进展。

01 元学习赋能机器人触觉识别,精度与泛化性俱佳

ICRA2026 | Tactile Recognition of Both Shapes and Materials with Automatic Feature Optimization-Enabled Meta Learning

发文团队:东南大学、北京理工大学等

研究方法

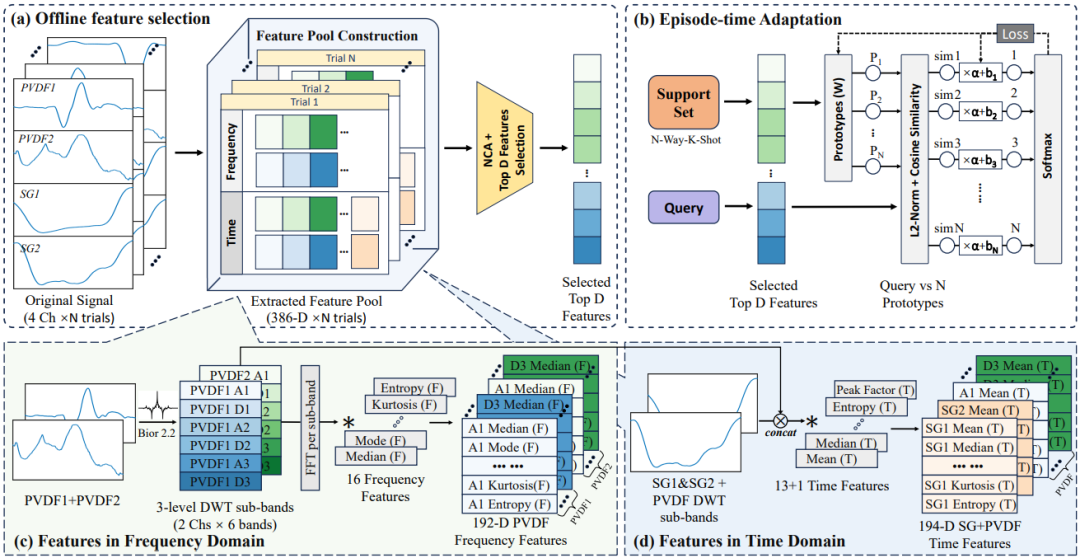

机器人触觉感知存在数据稀缺问题,研究提出AFOP-ML框架。

▲图|AFOP-ML算法框架

-

首次将元学习应用于基于压阻和压电原理触觉手指的形状与材质协同触觉识别任务。

-

框架除学习预测模型外,还能针对不同任务自适应确定最优特征空间,实现特征的自动优化选择。

-

搭建了包含时频域特征的386维特征池,结合NCA和维度扫描实现特征重要性排序与最优维度确定。

-

设计轻量级原型网络作为分类器后端,采用余弦-softmax原型头,大幅提升小样本下的适配速度与识别效率。

多维度验证了框架有效性,涵盖闭集识别、未知域泛化,还揭示了传感组件对不同触觉任务的贡献规律。

局限性

依赖特定四通道触觉传感器信号,训练阶段计算开销较大,未覆盖动态交互及极端力学条件下的识别场景,泛化至其他原理传感器的适配性不足。

02 触觉传感赋能CPR训练,闭环反馈低耗便携

ICRA2026 | A Closed-Loop CPR Training Glove with Integrated Tactile Sensing and Haptic Feedback

发文团队:华盛顿大学等

研究方法

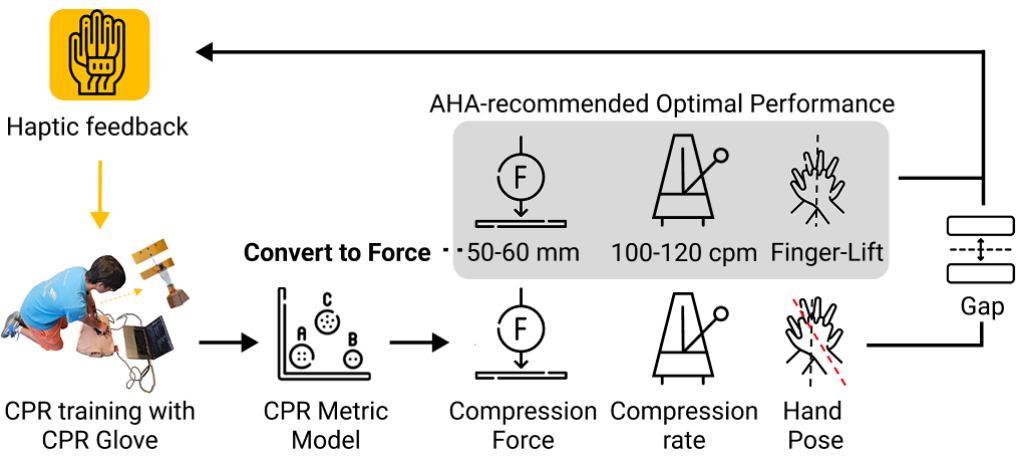

研究提出首款集成高分辨率触觉传感阵列和振动触觉执行器的闭环CPR训练手套,通过手掌和手背的分布式压力测量,实时估计按压速率、力度和手部姿势,并依此提供即时触觉反馈,减少对外部音视频显示的依赖。

▲图|闭环 CPR 自训练系统总体架构

首次将触觉传感技术应用于CPR训练,同时精准估计按压速率、力度、手部姿势三大核心指标,填补传统系统对姿势监测的空白。

提出自适应的CPR指标建模方法,依据训练者体重个性化设定按压力度目标,适配不同人群的身体特征。

设计了多维度触觉反馈编码方式,将按压速率映射为脉冲数、力度映射为振动强度、姿势映射为振动位置,实现单模态多信息传递。

局限性

用户样本量较小,动态场景下弱强度触觉反馈易被运动掩盖,复杂振动编码增加认知负荷,反馈模式需简化以提升实操感知可靠性。

深蓝具身智能

03 动态触觉表征学习,多任务泛化能力突出

ICLR2026 | AnyTouch 2: General Optical Tactile Representation Learning For Dynamic Tactile Perception

发文团队:中国人民大学高瓴人工智能学院、北京人工智能研究院、北京交通大学等

研究方法

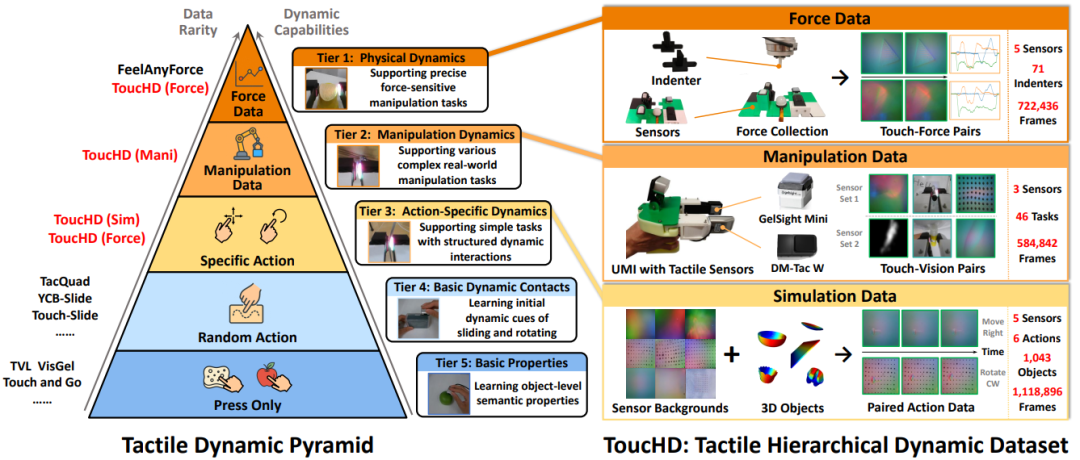

针对现有触觉数据集和模型缺乏动态感知支持的问题,研究提出触觉动态金字塔体系,构建大规模分层触觉数据集ToucHD,涵盖原子动作、真实世界操作和触力配对数据。

▲图|触觉动态金字塔与ToucHD数据集

按感知能力复杂度将数据分为5个层级,为动态触觉数据收集和模型设计提供系统性指导。

-

构建大规模分层触觉数据集ToucHD,包含242万+接触样本,填补高层级动态触觉数据空白,形成完整动态触觉数据生态。

-

设计多维度动态增强模块,通过帧差重建捕捉细粒度时序形变,动作匹配学习结构化动态语义,力预测建模物理动力学特性。

-

实现传感器无关的通用表征学习,融合多模态对齐与跨传感器匹配,支持GelSight、DIGIT等多种主流光学触觉传感器。

-

采用课程任务调度策略,按层级逐步优化多目标损失函数,平衡静态属性理解与动态感知能力的协同学习。

局限性

未充分利用多传感器配对数据的跨传感器协同优势,力数据采集局限于特制压头而非自然物体交互,未整合阵列式触觉传感器等异质数据格式。

04 仿指垫形变,提升VR几何探索触觉真实感

CHI 2026 | TactDeform: Finger Pad Deformation Inspired Spatial Tactile Feedback for Virtual Geometry Exploration

发文团队:悉尼大学

研究方法

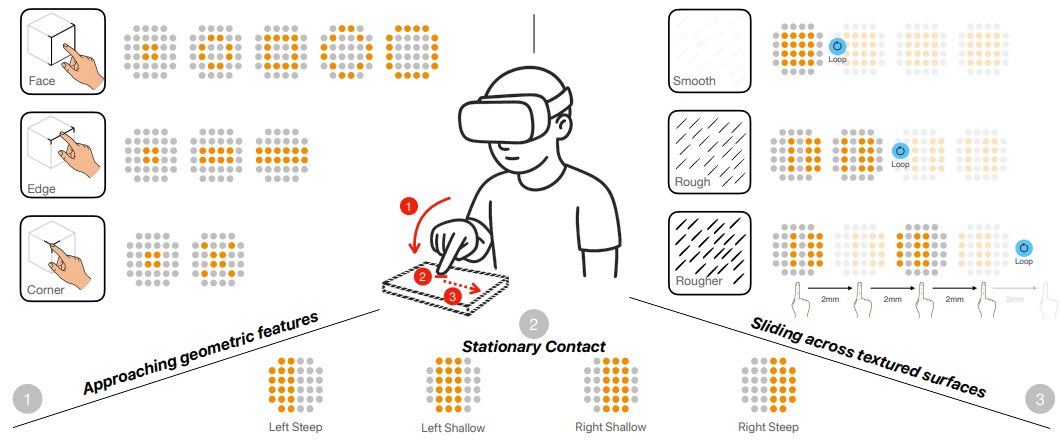

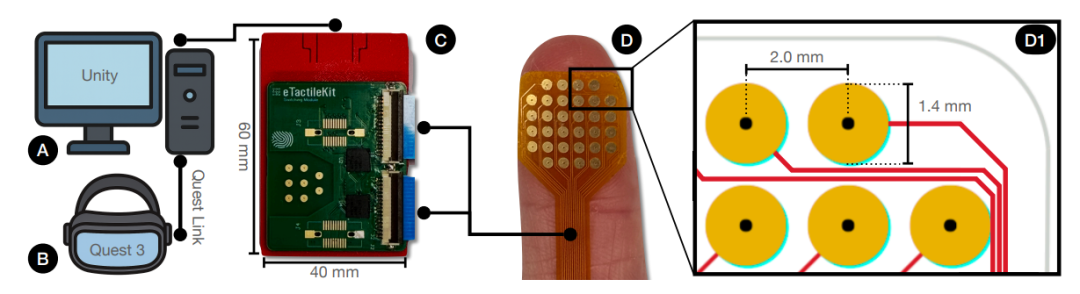

为解决VR中3D几何探索的触觉真实感难题,研究提出TactDeform系统,基于指垫自然形变原理,通过穿戴式32电极阵列提供时空触觉反馈。

▲图|TactDeform系统概述

该系统结合交互场景(接近、接触、滑动)与几何场景(特征、纹理)动态生成电触觉图案,仿真真实触摸时的指垫形变。

设计多维度时空触觉图案,接近时通过扩展图案传递几何特征,接触时依据手指朝向偏移刺激区域,滑动时通过参数化位移模拟纹理粗糙度。

▲图|该系统集成四个组件

开发轻量化穿戴式32电极阵列硬件,电极间距2mm贴合指垫触觉分辨阈值,实现毫米级空间分辨率的触觉反馈。

建立 velocity 与图案更新的联动机制,使触觉反馈与手指运动精准同步,增强交互沉浸感。

无需额外力反馈设备,仅通过电触觉刺激即可传递细粒度空间几何信息,突破传统设备物理限制,支持大范围自由探索。

局限性

仅采用单极性阳极电流,电极阵列覆盖范围有限导致无法实现全 3D 取向反馈,聚焦单指交互,未支持多指协同探索的真实场景需求。

05 触觉融合物理约束,同步估计姿态与接触

RAL2026 | Simultaneous Extrinsic Contact and In-Hand Pose Estimation via Distributed Tactile Sensing

发文团队:密歇根大学

研究方法

针对抓取操作中物体姿态和外部接触估计难题,研究提出基于因子图的TacGraph方法,融合分布式触觉传感与物理约束实现联合估计。

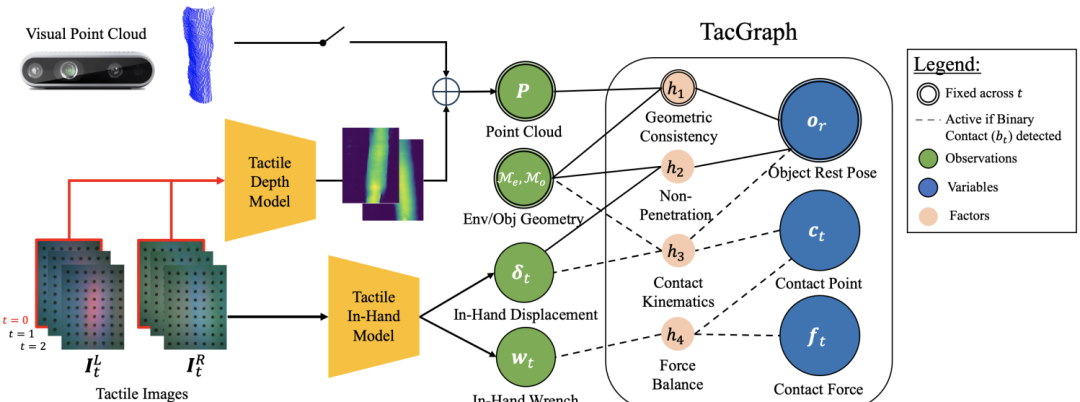

▲图|基于因子图的TacGraph

该方法通过目标无关的触觉模型提取几何点云、手部位移和握持力信息,构建包含几何一致性、无穿透、接触运动学和力平衡的因子图,高效求解最大后验估计。

-

提出目标无关的多模态触觉模型,从触觉图像中同步提取几何、位移和力信号,无需针对特定物体训练,泛化性强。

-

构建融合多重物理约束的因子图框架,首次同时纳入几何一致性、环境无穿透、接触运动学和力平衡四大因子,确保估计结果物理可信。

-

实现外在接触与手持姿态的联合估计,利用两者的耦合关系相互约束,有效解决单一传感模态下的歧义问题。

-

采用粒子初始化与迭代优化结合的推理策略,通过因子图代价函数筛选最优解,提升估计鲁棒性,避免局部最优。

无需依赖环境力/力矩传感器,仅通过抓手处的分布式触觉传感器即可完成精确估计,降低系统部署成本。

局限性

对初始化敏感,依赖已知物体与环境几何信息,未考虑物体滑动情况,仅支持单点接触描述,难以适配多接触点或复杂接触几何的交互场景。

06 核心趋势与未来展望

2026年机器人触觉领域的五大顶会成果,清晰勾勒出“感知-建模-应用”全链路的技术进化方向:

-

从数据层面,通过大规模分层数据集(ToucHD)填补动态触觉信息空白,用元学习突破小样本训练瓶颈;

-

从建模层面,实现静态属性与动态力感知的统一(AnyTouch 2)、物理约束与多模态信号的融合(TacGraph);

-

从应用层面,拓展出医疗训练(CPR手套)、VR交互(TactDeform)等垂直场景落地案例。

这些研究共同验证了三大核心共识:

多模态融合是提升触觉鲁棒性的关键(触觉+视觉/物理约束);

通用化表征是跨场景适配的核心(传感器无关学习、目标无关建模);

轻量化部署是实用化落地的前提(亚毫秒推理、便携硬件设计)。

当前技术仍面临动态复杂交互场景的适配、多传感器异质数据的融合、极端环境下的感知稳定性等共性挑战。

未来,随着触觉与视觉、力控、大模型的深度结合,或有望进一步实现“指尖感知-大脑推理-精准执行”的闭环优化。

Ref

1. Tactile Recognition of Both Shapes and Materials with Automatic Feature Optimization-Enabled Meta Learning https://arxiv.org/abs/2603.08423v1

2. A Closed-Loop CPR Training Glove with Integrated Tactile Sensing and Haptic Feedback https://arxiv.org/pdf/2603.05793

3. AnyTouch 2: General Optical Tactile Representation Learning For Dynamic Tactile Perception https://arxiv.org/pdf/2602.09617v1

4. TactDeform: Finger Pad Deformation Inspired Spatial Tactile Feedback for Virtual Geometry Exploration https://arxiv.org/pdf/2602.03476v1

5. Simultaneous Extrinsic Contact and In-Hand Pose Estimation via Distributed Tactile Sensing https://arxiv.org/pdf/2512.23856v1

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)