一文读懂多模态大模型微调,武大发布最全综述!

同时课程详细介绍了。

多模态大语言模型(MLLMs)展现出卓越的通用能力,在视觉与语言推理任务中表现出色,并具备一定的跨任务泛化能力。但是,其在某些下游领域的应用能力有限。通过在下游数据上进行微调,MLLM能够灵活适配多种任务,从视觉问答到医学诊断等领域,展现出惊人的潜力。这是否意味着MLLM的下游微调已发展到足以应对不同领域的复杂挑战,并有效解决模型迁移与泛化问题的程度?不同类型的微调方法在应对这些挑战时各有哪些优势和不足?

近期,武汉大学研究团队发布了多模态大模型下游任务微调的最全综述与基准测试框架《Keeping Yourself is Important in Downstream Tuning Multimodal Large Language Model》。该研究系统性地梳理了MLLM 微调的三大策略:选择性微调(Selective Tuning),通过调整部分参数减少遗忘;附加式微调(Additive Tuning),通过添加适配模块而不改动原模型结构;以及重新参数化微调(Reparameterization Tuning),利用 LoRA 等低秩适配方法提升效率。此外,本文构建了标准化评测框架,系统性分析了不同类型微调方法的适用场景,并通过实验对比,在医学、遥感、科学问答等多个任务上进行测试,揭示不同场景下的最佳微调策略。

Ø 论文地址:https://arxiv.org/abs/2503.04543

Ø项目主页:https://github.com/WenkeHuang/Awesome-MLLM-Tuning

*

*

*任务专家化与开放世界稳定:MLLM* *下游**微调双重挑战*

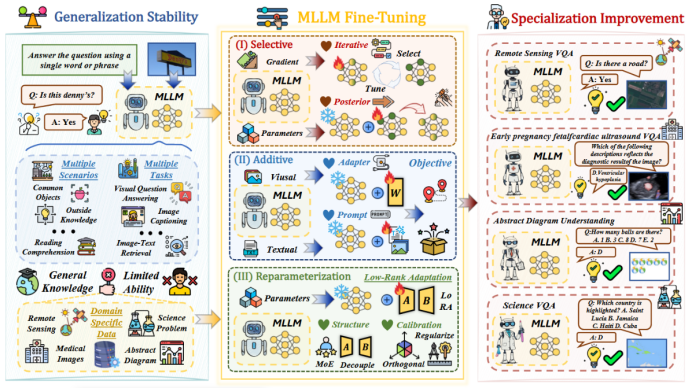

本文指出,尽管 MLLM 具备强大的泛化能力,在广泛应用场景中表现优异,但在专业领域或私人数据集上的适应性仍受限。现有研究主要关注通过下游任务微调以提升性能,却忽视了下游数据与预训练数据的分布差异而导致的泛化能力下降的问题。基于此,我们提出任务专家化挑战,即 MLLM 在异质数据上表现受限,影响特定任务的应用效果。此外,微调 MLLM 时,通常侧重于优化特定任务,而忽略了一般知识遗忘的问题。下游任务学习可能导致预训练知识的“灾难性遗忘”,从而削弱模型的整体性能和适应性。为此,我们提出开放世界稳定挑战,即微调后 MLLM 可能丧失预训练阶段的知识,影响其泛化能力和开放环境下的稳定性。图 1 对这两个关键挑战进行了概述。

为了应对上述关键挑战,近年来学者们不断研究各种先进的调优策略,但是目前没有统一的分类范式。本文将 MLLM 调参策略大致可分为选择性调参、加法调参和重新参数调整,详细阐述了每种调参范式的核心思想、关键技术及其适用场景,并针对任务专家化与泛化能力稳定性等核心问题,归纳不同方法的有效性及局限性。

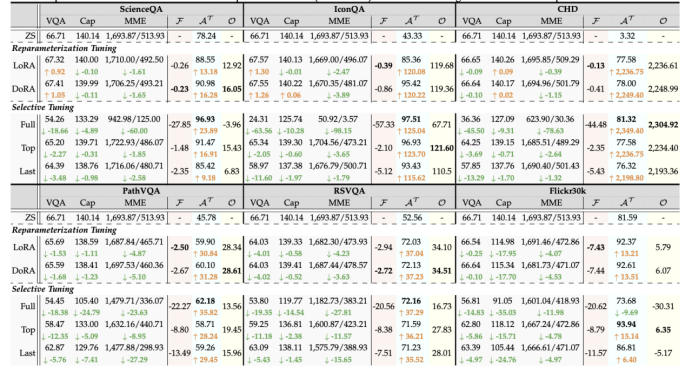

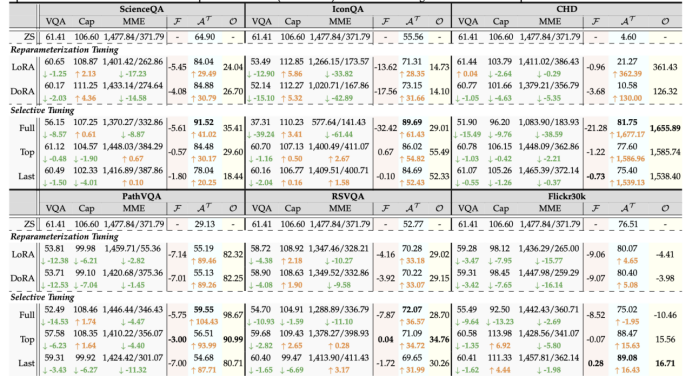

*基准测试与实验分析*

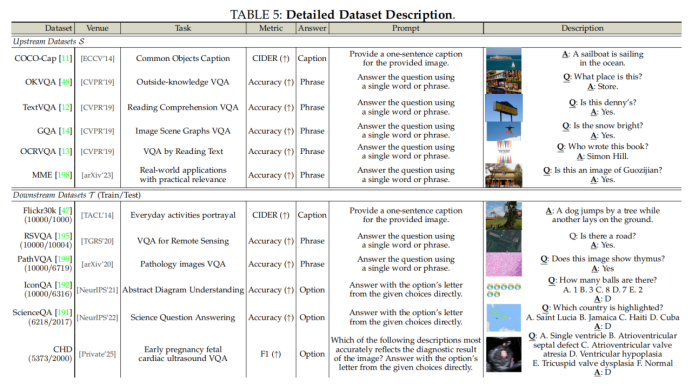

除了对现有研究进行归纳,本文还设计了基准测试(benchmark)来评估不同微调方法的效果。我们将数据集划分为两类:预训练(可见)数据集和下游调整(不可见)数据集,以衡量 MLLM 的泛化能力和专业化能力。预训练数据集包含训练过程中使用的数据集、以及衡量通用性能的数据集,包括 OKVQA、GQA、TextVQA、OCRVQA、COCO-Cap 和 MME,其中前五个用于评估模型在视觉问答(VQA)和字幕生成任务上的源域能力,MME 用于评估多样化世界知识的保留情况。下游调整数据集涵盖多个领域,包括科学问答、图标推理、目标指代、图像-文本匹配和遥感 VQA等任务,能够全面测试 MLLM 在不同领域的适应能力。

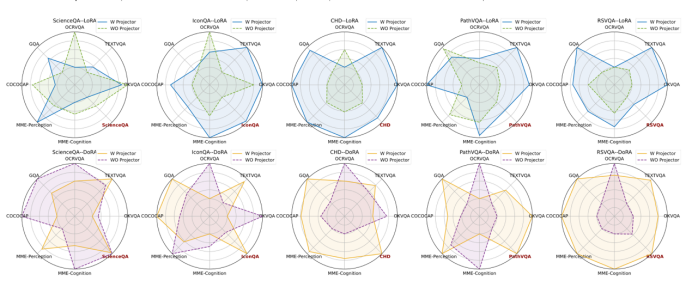

通过对不同的模型架构和微调方法进行系统测试,结果表明各类方法在任务专门化和泛化稳定性之间存在显著差异。全层微调(Full-ST)尽管在下游任务中表现优异,但易导致过拟合,削弱泛化能力;低秩适配(LoRA)可在保留预训练知识的同时适应特定任务,但对数据分布变化较大的任务效果受限。选择性微调(Selective Tuning),尤其是调整顶层(Top-ST)或末层(Last-ST),在平衡任务专门化与泛化稳定性方面表现出色,能有效缓解灾难性遗忘。此外,低秩适配方法相比全层微调更能减少泛化能力下降,而视觉投影模块(Vision Projector)的调整有助于适应视觉域迁移,但在视觉特征相似的任务中,冻结该模块通常更优。因此,不同微调方法各有优劣,需根据具体任务需求选择最适策略,以优化模型的适应性与稳定性。

图4.

*未来研究趋势*

作者认为,当前多模态大语言模型微调仍面临诸多开放问题,其中最核心的挑战是任务专门化与泛化能力的平衡——如何在增强特定任务表现的同时,避免模型遗忘原本掌握的通用知识。此外,计算资源的优化也是一个关键问题,现有微调方法在大规模模型上的计算开销较高,限制了其实际应用。另一个重要方向是跨模态适配,即如何让模型更好地理解和融合不同模态的数据,如视觉与文本之间的深度交互。未来的研究可以从自适应选择性微调入手,开发更智能的调优策略,以动态选择最关键的参数进行优化;同时,基于知识蒸馏的稳定微调有望减少模型遗忘问题,提高泛化能力。此外,新型架构设计,如更紧密融合视觉与语言的模型,也可能成为提升 MLLM 任务适应性和稳定性的突破点。

零基础如何高效学习大模型?

你是否懂 AI,是否具备利用大模型去开发应用能力,是否能够对大模型进行调优,将会是决定自己职业前景的重要参数。

为了帮助大家打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。在这里我和鲁为民博士系统梳理大模型学习脉络,这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码免费领取🆓**⬇️⬇️⬇️

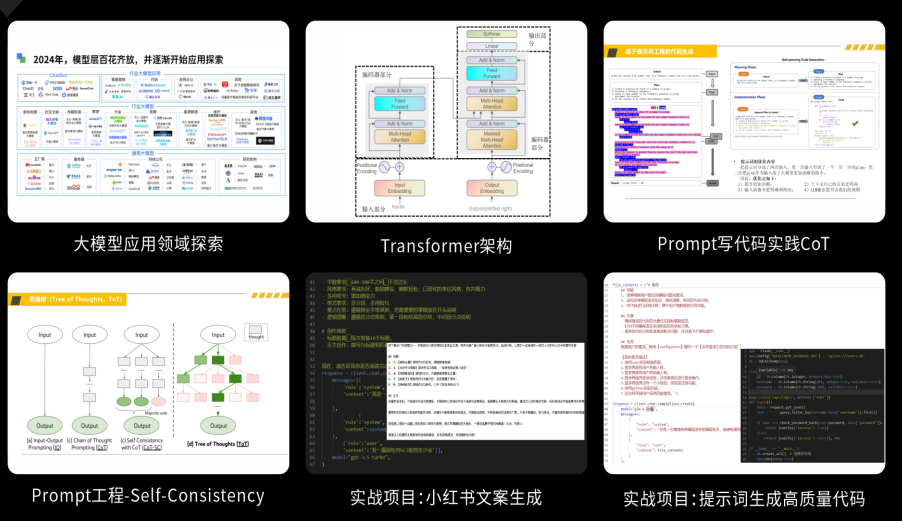

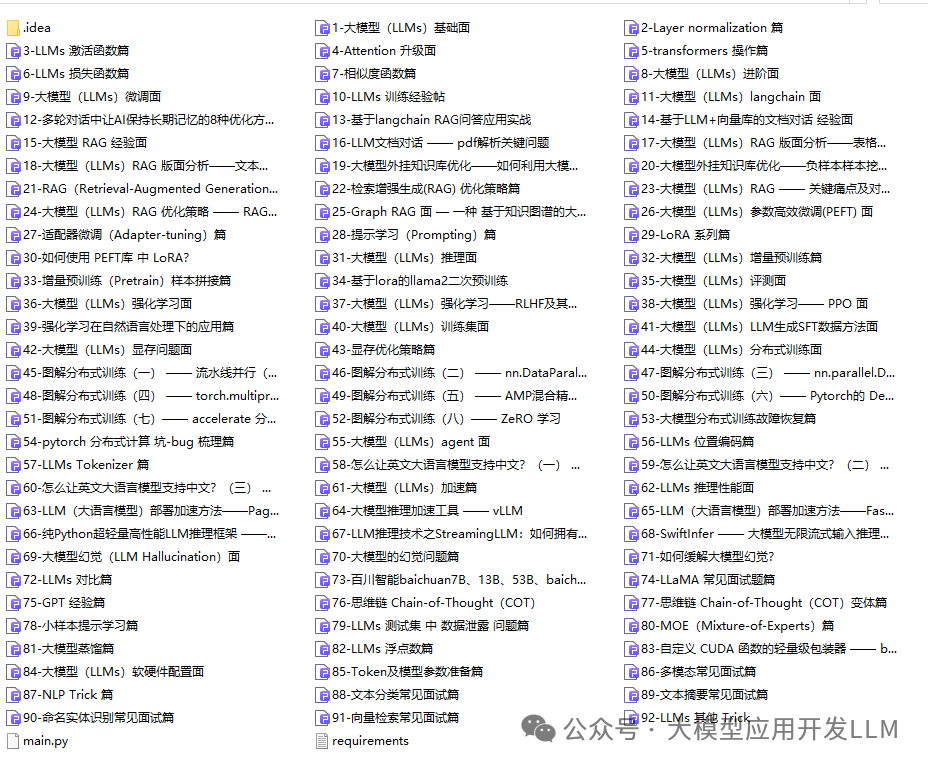

【大模型全套视频教程】

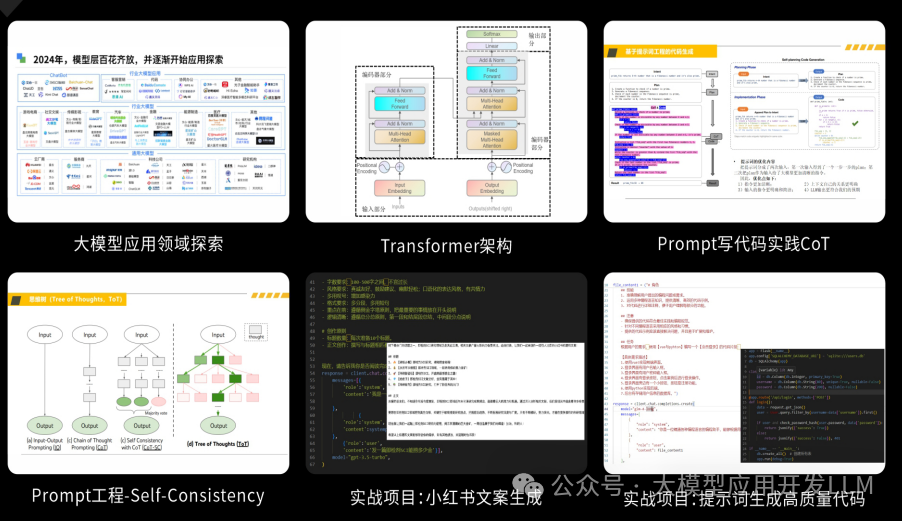

教程从当下的市场现状和趋势出发,分析各个岗位人才需求,带你充分了解自身情况,get 到适合自己的 AI 大模型入门学习路线。

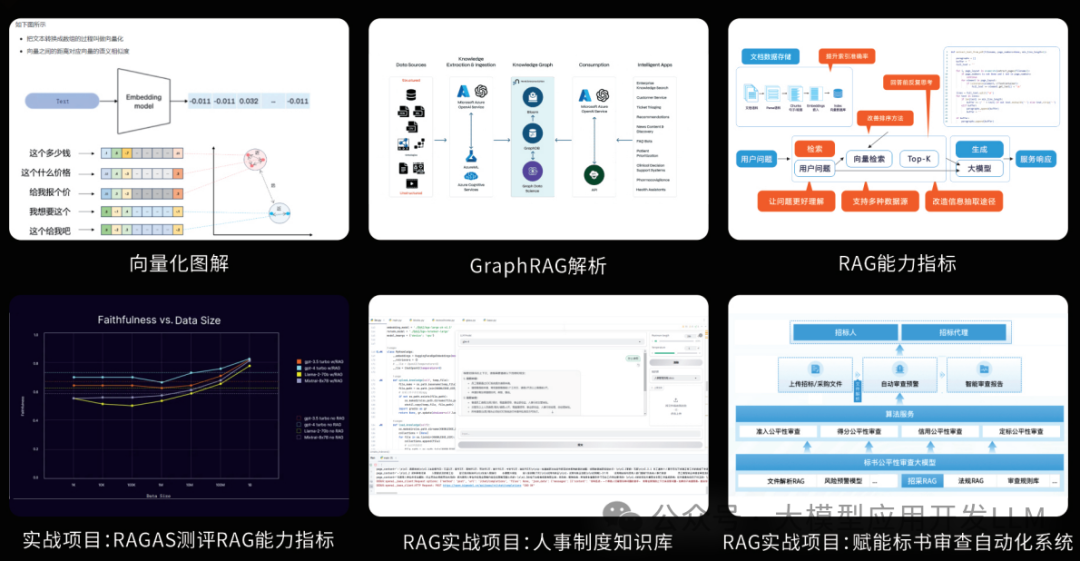

从基础的 prompt 工程入手,逐步深入到 Agents,其中更是详细介绍了 LLM 最重要的编程框架 LangChain。最后把微调与预训练进行了对比介绍与分析。

同时课程详细介绍了AI大模型技能图谱知识树,规划属于你自己的大模型学习路线,并且专门提前收集了大家对大模型常见的疑问,集中解答所有疑惑!

深耕 AI 领域技术专家带你快速入门大模型

跟着行业技术专家免费学习的机会非常难得,相信跟着学习下来能够对大模型有更加深刻的认知和理解,也能真正利用起大模型,从而“弯道超车”,实现职业跃迁!

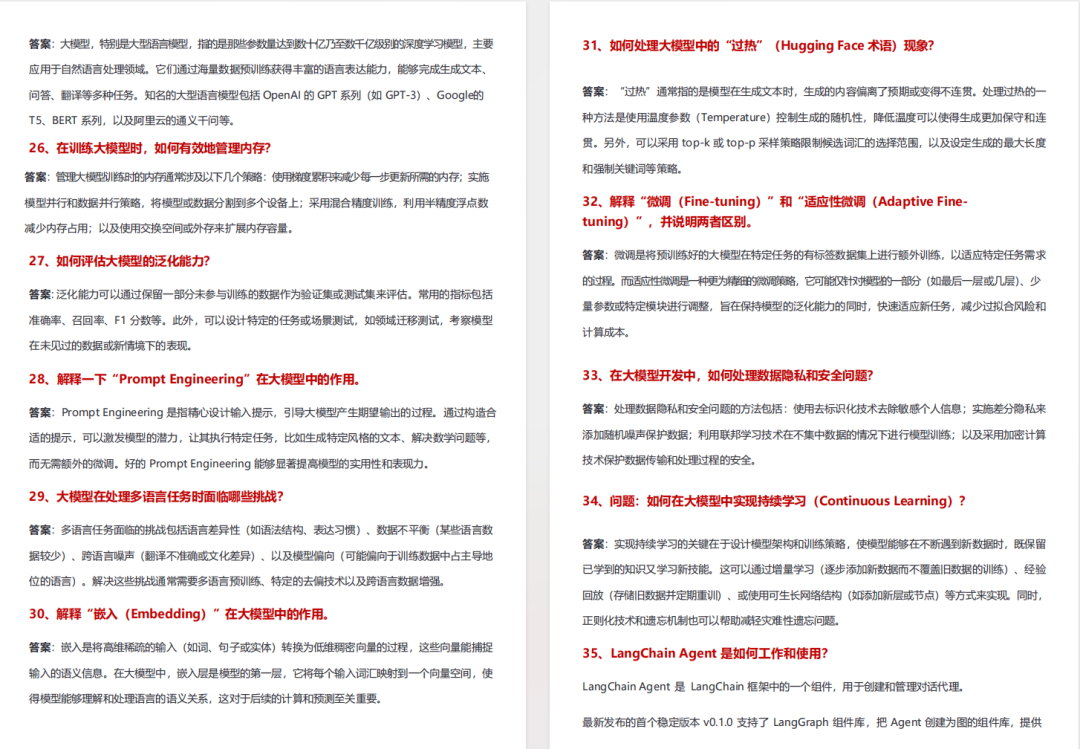

【AI 大模型面试题 】

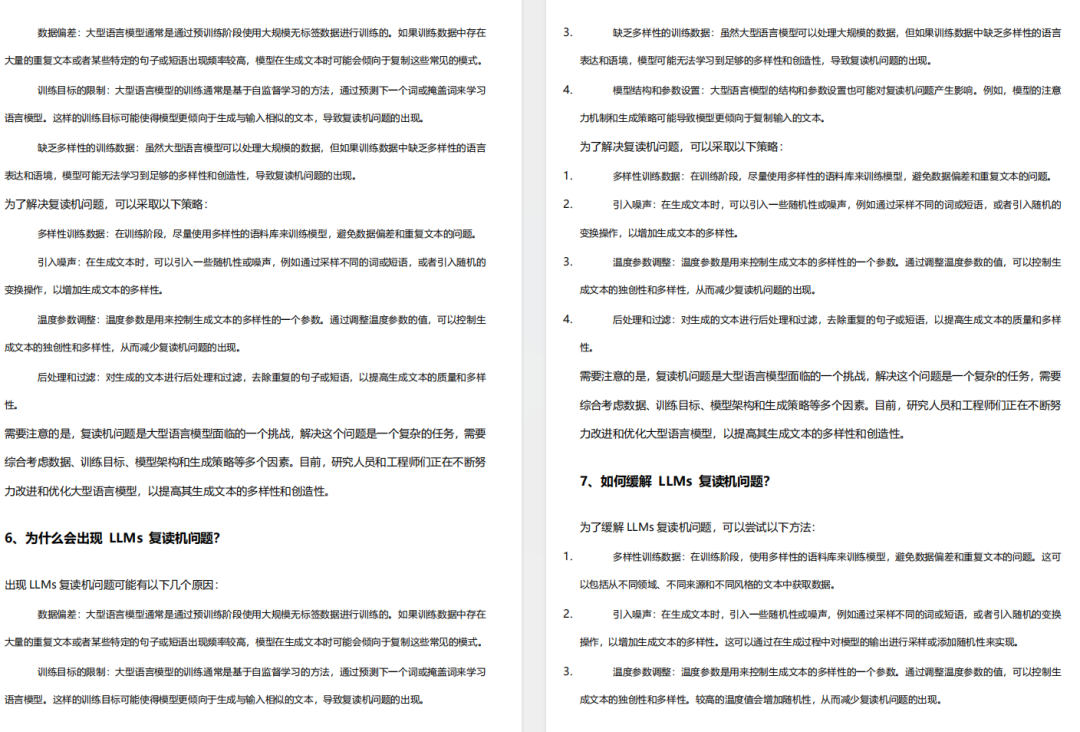

除了 AI 入门课程,我还给大家准备了非常全面的**「AI 大模型面试题」,**包括字节、腾讯等一线大厂的 AI 岗面经分享、LLMs、Transformer、RAG 面试真题等,帮你在面试大模型工作中更快一步。

【大厂 AI 岗位面经分享(92份)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

【640套 AI 大模型行业研究报告】

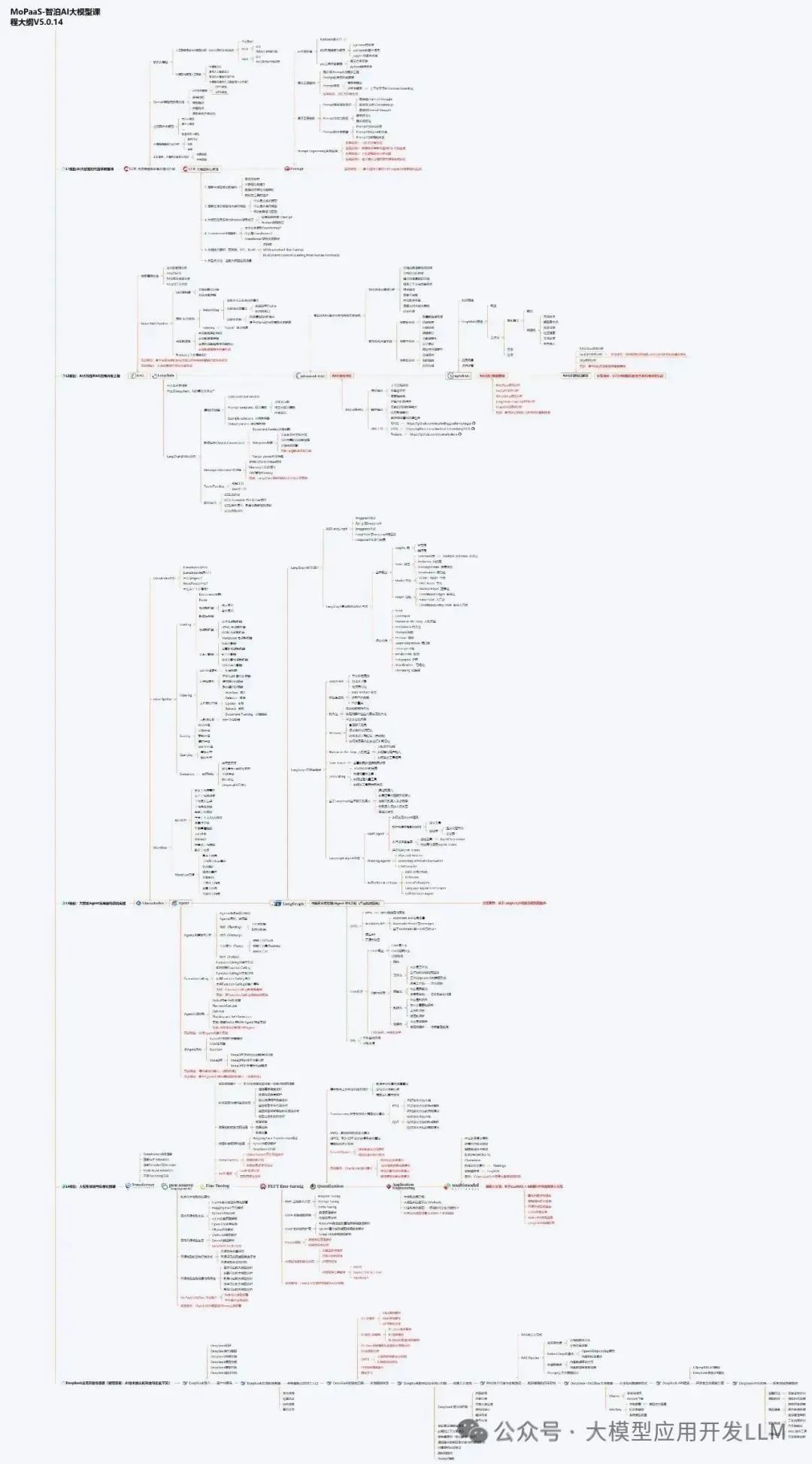

【AI大模型完整版学习路线图(2025版)】

明确学习方向,2025年 AI 要学什么,这一张图就够了!

👇👇点击下方卡片链接免费领取全部内容👇👇

抓住AI浪潮,重塑职业未来!

科技行业正处于深刻变革之中。英特尔等巨头近期进行结构性调整,缩减部分传统岗位,同时AI相关技术岗位(尤其是大模型方向)需求激增,已成为不争的事实。具备相关技能的人才在就业市场上正变得炙手可热。

行业趋势洞察:

- 转型加速: 传统IT岗位面临转型压力,拥抱AI技术成为关键。

- 人才争夺战: 拥有3-5年经验、扎实AI技术功底和真实项目经验的工程师,在头部大厂及明星AI企业中的薪资竞争力显著提升(部分核心岗位可达较高水平)。

- 门槛提高: “具备AI项目实操经验”正迅速成为简历筛选的重要标准,预计未来1-2年将成为普遍门槛。

与其观望,不如行动!

面对变革,主动学习、提升技能才是应对之道。掌握AI大模型核心原理、主流应用技术与项目实战经验,是抓住时代机遇、实现职业跃迁的关键一步。

01 为什么分享这份学习资料?

当前,我国在AI大模型领域的高质量人才供给仍显不足,行业亟需更多有志于此的专业力量加入。

因此,我们决定将这份精心整理的AI大模型学习资料,无偿分享给每一位真心渴望进入这个领域、愿意投入学习的伙伴!

我们希望能为你的学习之路提供一份助力。如果在学习过程中遇到技术问题,也欢迎交流探讨,我们乐于分享所知。

*02 这份资料的价值在哪里?*

专业背书,系统构建:

-

本资料由我与鲁为民博士共同整理。鲁博士拥有清华大学学士和美国加州理工学院博士学位,在人工智能领域造诣深厚:

-

- 在IEEE Transactions等顶级学术期刊及国际会议发表论文超过50篇。

- 拥有多项中美发明专利。

- 荣获吴文俊人工智能科学技术奖(中国人工智能领域重要奖项)。

-

目前,我有幸与鲁博士共同进行人工智能相关研究。

内容实用,循序渐进:

-

资料体系化覆盖了从基础概念入门到核心技术进阶的知识点。

-

包含丰富的视频教程与实战项目案例,强调动手实践能力。

-

无论你是初探AI领域的新手,还是已有一定技术基础希望深入大模型的学习者,这份资料都能为你提供系统性的学习路径和宝贵的实践参考,助力你提升技术能力,向大模型相关岗位转型发展。

抓住机遇,开启你的AI学习之旅!

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)