具身智能十年演进

摘要: 具身智能(Embodied AI)在2015-2025年经历了从“脑体分离”到“脑体合一”的范式演进。早期(2015-2018)依赖割裂的视觉、规划与控制模块,系统脆弱;中期(2019-2022)通过强化学习与仿真训练实现物理技能突破;2025年则迈向VLA原生模型(端到端神经网络)、eBPF内核级安全(实时动作审计)与触觉语义化,使机器人具备物理常识与通用任务能力。技术跨越体现在智能来源

具身智能(Embodied AI) 的十年(2015–2025),是从“大脑与身体分离”向“脑体合一、物理常识涌现”演进的十年。

这十年中,AI 从只能在服务器里处理比特(Bit)的“数字灵魂”,演变成了能够感知、移动并操作原子(Atom)的“物理实体”。

一、 核心演进的三大范式转移

1. 任务特定与分级控制期 (2015–2018) —— “孤立的智能”

-

核心特征: 视觉、规划、控制三个模块完全割裂。

-

技术逻辑: * 视觉模型负责识别物体(如 SSD, YOLO);

-

规划模型负责寻找路径(如 A*);

-

控制模块负责驱动电机(如 PID/MPC)。

-

痛点: 这种“缝合怪”系统极度脆弱。只要光影一变或物体移动,整个逻辑链条就会断裂。机器人没有“常识”,不知道摔倒了该如何爬起来。

2. 强化学习与 Sim-to-Real 突破期 (2019–2022) —— “直觉的萌芽”

-

核心特征: 大规模并行仿真 与 深度强化学习 (Deep RL)。

-

技术跨越:

-

数据飞轮: 机器人不再靠程序员写死规则,而是在 NVIDIA Isaac 或 PyBullet 等仿真器里通过数亿次试错自学。

-

灵巧操作: OpenAI 展示了能解魔方的灵巧手,证明了神经网络可以处理极高维度的物理接触。

-

里程碑: 解决了“窄域”下的物理技能问题,机器人开始具备应对复杂地形和突发推搡的鲁棒性。

3. 2025 大模型驱动与原生具身时代 —— “脑体合一与通用性”

- 2025 现状:

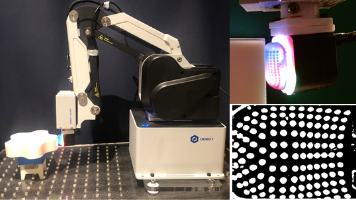

- VLA 原生模型 (Vision-Language-Action): 2025 年的具身智能(如 RT-3、Figure 02、Tesla Optimus Gen 3)实现了真正的端到端。从看到图像到输出关节力矩,只有一个神经网络。它不仅会干活,还具备了物理常识(知道玻璃易碎,知道水能导电)。

- eBPF 内核级安全栅栏: 为了管控大模型的非线性行为,SE 利用 eBPF 在系统内核层实时审计动作流,防止模型产生伤害人类的物理动作。

- 触觉语义化: 机器人不仅能看见,其皮肤上的柔性传感器通过 eBPF 实时反馈,使其具备了人类级别的“手感”。

二、 具身智能核心维度十年对比表

| 维度 | 2015 (传统机器人) | 2025 (具身智能体) | 核心跨越点 |

|---|---|---|---|

| 智能来源 | 人工编写的几何规则 | 从海量视频与仿真中学习的直觉 | 从“复刻动作”到“理解物理” |

| 泛化能力 | 极低 (换个桌子就失灵) | 极高 (能在陌生家庭完成家务) | 实现了跨场景、跨物体的通用性 |

| 交互范式 | 编程指令 / 代码 | 自然语言指令 (Open-ended) | AI 能够拆解“帮我做顿早餐”的任务 |

| 感知融合 | 视觉、深度独立处理 | 多模态对齐 (视觉+触觉+本体感) | 实现了类似生物的综合感知 |

| 系统安全 | 物理围栏 | eBPF 内核级物理边界限制 | 安全性从环境限制转为系统层保护 |

三、 2025 年的技术巅峰:从“算法”到“数字生物”

在 2025 年,具身智能的突破在于其系统级的进化:

- eBPF 驱动的“本体安全感”:

由于 2025 年的控制模型极其复杂,一旦模型崩溃,机器人可能失控。

- 实时熔断: SE 利用 eBPF 在 Linux 内核态监控每一个关节的功耗与速度张量。如果 AI 输出了一个可能导致关节自毁的信号,eBPF 会在 内将其强制拉回安全包络线,这种“内核态反馈”是保证机器人走进家庭的前提。

- 可微物理引擎的在线预测:

现在的机器人具备了“想象力”。在触碰一个未知物体前,它利用本地 HBM3e 算力瞬间进行数千次物理模拟,预测物体的滚动方向或破碎可能性。 - HBM3e 与本地万亿级长文本记忆:

2025 年的具身智能体能记住你过去一年的生活习惯。它知道你喜欢的咖啡浓度,也知道你经常随手放钥匙的位置,这种“长期具身记忆”是通过本地高速算力卡实现的。

四、 总结:具身智能的“安卓时刻”

过去十年的演进,是将 AI 从**“屏幕里的文字游戏”重塑为“能够分担人类劳作、具备物理感知与内核级安全保障的数字生命”**。

- 2015 年: 你在纠结如何让机械臂识别出一颗苹果。

- 2025 年: 你在利用 eBPF 审计下的 VLA 模型,让机器人根据你的心情和冰箱里的剩菜,自主发明并烹饪出一道新菜肴。

更多推荐

已为社区贡献166条内容

已为社区贡献166条内容

所有评论(0)