ICCV 2025 | 小模型也能更“懂”多模态!LLaVA-KD:多模态大语言模型蒸馏框架

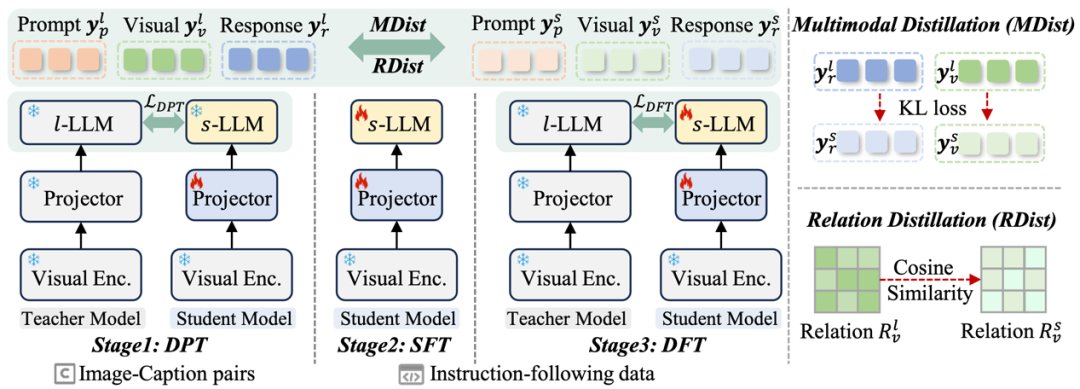

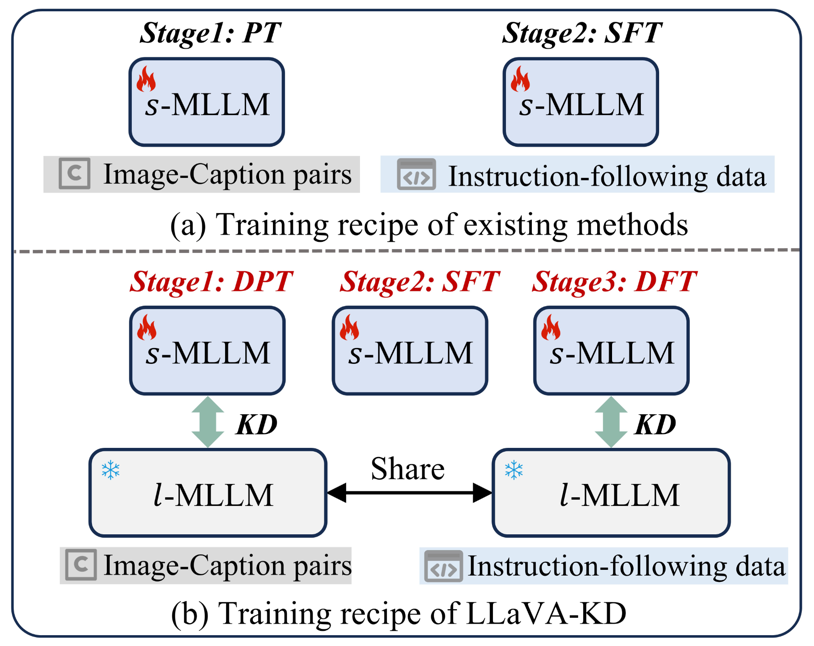

现有方法主要通过采用轻量级LLM骨干网络,同时沿用大型MLLM(l-MLLM)的传统“两阶段”训练范式,即预训练(PT)与有监督微调(SFT),以实现视觉与语言特征的跨模态对齐与理解。该方法设计了三阶段训练流程,包括用于增强多模态对齐的蒸馏预训练(DPT)、知识获取的有监督微调(SFT)以及知识迁移的蒸馏微调(DFT)。此外,我们提出创新性的蒸馏策略,将多模态蒸馏(MDist)与关系蒸馏(RDis

点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

点击进入—>【顶会/顶刊】投稿交流群

添加微信号:CVer2233,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

(来自华中科大、浙大、腾讯优图、华中农大)

(来自华中科大、浙大、腾讯优图、华中农大)

论文:https://arxiv.org/abs/2410.16236v3

项目代码:github.com/Fantasyele/LLaVA-KD

内容总结(太长不看版)

大规模多模态模型(l-MLLMs)日益增长的模型规模与计算复杂度,限制了其在资源受限场景中的应用。尽管小规模多模态模型(s-MLLMs)能够降低计算开销,但往往面临性能下降的问题。为缓解这一限制,本文提出了一种新颖的LLaVA-KD框架,将l-MLLMs的知识迁移到s-MLLMs。具体而言,我们引入了多模态蒸馏(MDist)以传递教师模型在视觉和语言模态下的鲁棒表征,以及关系蒸馏(RDist)以传递教师模型捕捉视觉token间关系的能力。此外,本文提出了三阶段训练方案,以充分发挥所提蒸馏策略的潜力:1)蒸馏预训练,增强s-MLLMs中视觉-语言表征的对齐;2)有监督微调,赋予s-MLLMs多模态理解能力;3)蒸馏微调,进一步优化s-MLLM的知识。我们的方法在不改变模型结构的前提下,显著提升了s-MLLMs的性能。大量实验和消融研究验证了各个组件的有效性。

图1 LLaVA-KD框架结构图

1、引言

近年来,得益于大语言模型(LLM)在自然语言处理领域的巨大突破,研究者们开始积极探索多模态大语言模型(MLLM)。此类模型通过集成视觉编码器、特征投影器与LLM,实现了视觉与语言信息的统一理。然而,MLLM的成功受益于模型规模的Scale law,导致模型参数量和推理成本大幅提升,进而限制了其在资源受限场景下的应用。

2、LLaVA-KD贡献

近年来,小规模多模态大语言模型(s-MLLM)因其高效性而受到关注。现有方法主要通过采用轻量级LLM骨干网络,同时沿用大型MLLM(l-MLLM)的传统“两阶段”训练范式,即预训练(PT)与有监督微调(SFT),以实现视觉与语言特征的跨模态对齐与理解。然而,该训练范式本质上为l-MLLM设计,直接迁移至s-MLLM往往因模型容量受限而表现不佳。

近期工作通常依赖于额外的结构改造或数据工程进行优化。

图2 LLaVA-KD的训练框架

针对上述不足,本文创新性地提出基于训练范式优化的s-MLLM性能提升方案,无需模型结构改动与额外数据工程,聚焦于高效知识迁移。我们系统分析了知识蒸馏(KD)在MLLM中的应用潜力,发现以往蒸馏工作多聚焦文本模态,忽视了视觉模态在跨模态理解中的作用。为此,本文提出两项关键创新:(1)多模态蒸馏(MDist),首次将蒸馏目标扩展至视觉与语言双模态,实现全面多模态表征迁移;(2)关系蒸馏(RDist),显式转移教师模型对视觉token间空间与语义关系的建模能力,进一步提升s-MLLM对复杂场景的理解力。

进一步地,考虑到仅在SFT阶段引入蒸馏难以充分发挥效果,本文提出优化的三阶段训练框架:首先在预训练阶段引入蒸馏(DPT),强化视觉-语言对齐;其次通过SFT获取基础能力;最后追加蒸馏微调(DFT),精细化迁移知识。实验结果表明,所提LLaVA-KD框架在多个多模态基准上全面优于现有s-MLLM方法,有效弥补了容量受限带来的性能瓶颈。具体来说,我们的贡献如下:

1) 我们提出了LLaVA-KD,一种面向MLLM的新型蒸馏框架,实现大规模MLLM向小规模MLLM的知识迁移。该方法设计了三阶段训练流程,包括用于增强多模态对齐的蒸馏预训练(DPT)、知识获取的有监督微调(SFT)以及知识迁移的蒸馏微调(DFT)。

2) 此外,我们提出创新性的蒸馏策略,将多模态蒸馏(MDist)与关系蒸馏(RDist)结合,既优化视觉和语言双模态表征,又提升s-MLLM对视觉token间关系的建模能力。

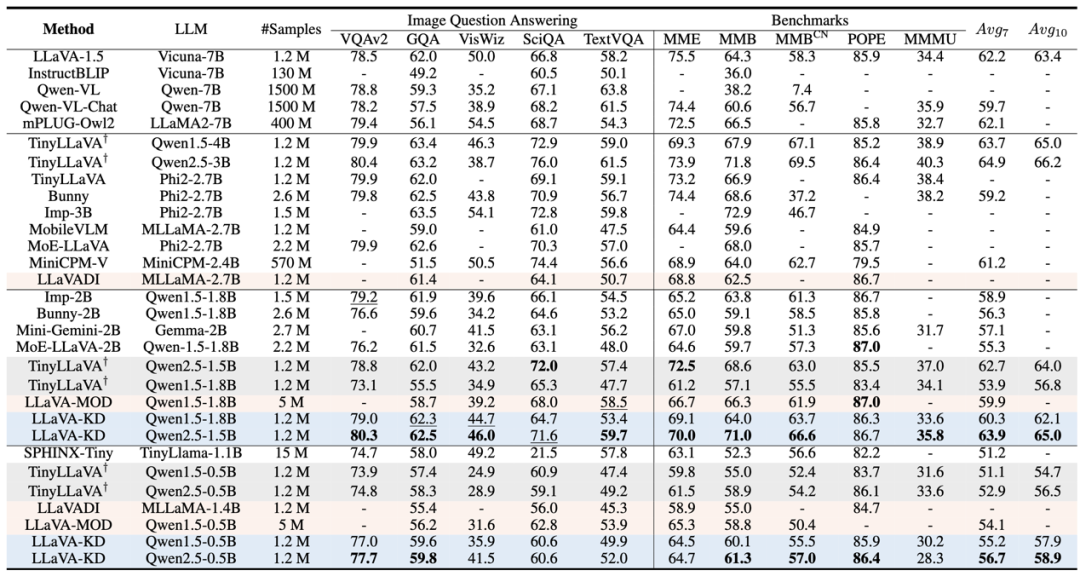

3) 在多个主流多模态基准上的实验结果表明,LLaVA-KD在性能上全面优于现有主流s-MLLM方法。

3、实验结果

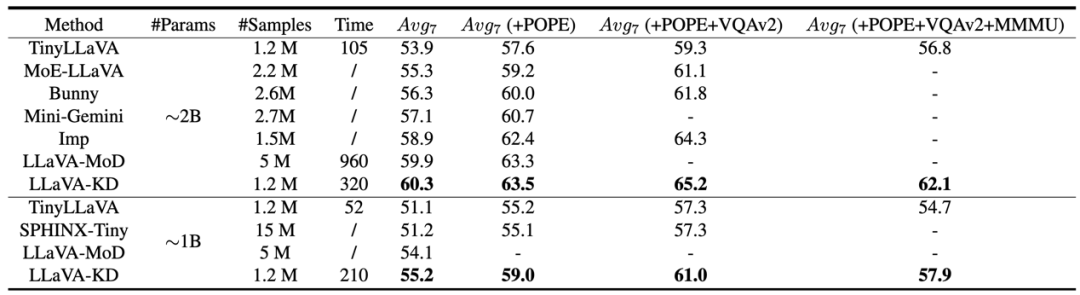

表1 LLaVA-KD与现有多模态大模型性能比较

表2 LLaVA-KD与现有s-MLLMs效率和性能比较

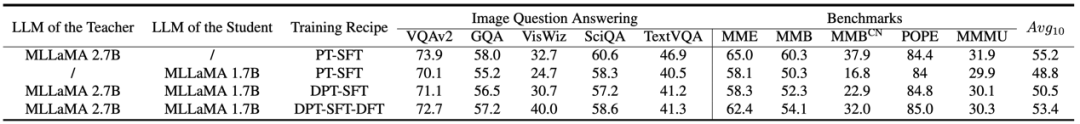

表3 在其他系列MLLMs上LLaVA-KD的有效性

图3 LLaVA-KD与其Baseline定性实验结果对比

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ICCV 2025 论文和代码下载

在CVer公众号后台回复:ICCV2025,即可下载ICCV 2025论文和代码开源的论文合CVPR 2025 论文和代码下载

在CVer公众号后台回复:CVPR2025,即可下载CVPR 2025论文和代码开源的论文合集

CV垂直方向和论文投稿交流群成立

扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-垂直方向和论文投稿微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。 一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者论文投稿+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码或加微信号: CVer2233,进交流群

CVer计算机视觉(知识星球)人数破万!如果你想要了解最新最快最好的CV/DL/AI论文、实战项目、行业前沿、从入门到精通学习教程等资料,一定要扫描下方二维码,加入CVer知识星球!最强助力你的科研和工作!

▲扫码加入星球学习

▲扫码或加微信号: CVer2233,进交流群

CVer计算机视觉(知识星球)人数破万!如果你想要了解最新最快最好的CV/DL/AI论文、实战项目、行业前沿、从入门到精通学习教程等资料,一定要扫描下方二维码,加入CVer知识星球!最强助力你的科研和工作!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号 整理不易,请点赞和在看

更多推荐

已为社区贡献64条内容

已为社区贡献64条内容

所有评论(0)