英伟达:多模态强化学习框架MR-SP

如何有效地扩展强化学习(RL)以处理长视频的复杂推理任务?论文提出了一种新的多模态强化学习框架MR-SP,专门针对长视频的推理,提高了模型在处理长时间序列数据时的效率和效果。

📖标题:Scaling RL to Long Videos

🌐来源:arXiv, 2507.07966

🌟摘要

我们引入了一个全栈框架,该框架利用强化学习将视觉语言模型 (VLM) 中的推理扩展到长视频。我们通过集成三个关键组件来解决长视频推理的独特挑战:(1)大规模数据集 LongVideo-Reason,包括 52K 长视频 QA 对,具有跨不同领域的高质量推理注释,例如运动、游戏和 vlog; (2) 两阶段训练管道,通过思维链监督微调 (CoT-SFT) 和强化学习 (RL) 扩展 VLM; (3) 长视频 RL 的训练基础设施,称为多模态强化序列并行性 (MR-SP),它结合了序列并行性和基于 vLLM 的长视频引擎,使用缓存的用户嵌入进行有效的推出和预填充。在实验中,LongVILA-R1-7B 在 VideoMME 等长视频 QA 基准上实现了强大的性能。它还优于 Video-R1-7B,甚至可以在我们的 LongVideo-Reason-eval 基准上跨时间推理、目标和目的推理、空间推理和情节推理匹配 Gemini-1.5-Pro。值得注意的是,我们的 MR-SP 系统在长视频 RL 训练上实现了高达 2.1 倍的加速。LongVILA-R1 表现出与输入视频帧尺度的数量一致的性能提升。LongVILA-R1 标志着企业在 VLM 中朝着长视频推理迈出一步。此外,我们发布了我们的公共可用性训练系统,该系统支持对各种模式(视频、文本和音频)、各种模型(VILA 和 Qwen 系列)的 RL 训练,甚至图像和视频生成模型。在单个 A100 节点 (8 个 GPU) 上,它支持对小时长视频(例如,3,600 帧/大约 256k 个令牌)的 RL 训练。代码和模型可在 https://github.com/NVlabs/Long-RL 获得。

🛎️文章简介

🔸研究问题:如何有效地扩展强化学习(RL)以处理长视频的复杂推理任务?

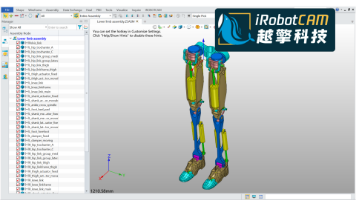

🔸主要贡献:论文提出了一种新的多模态强化学习框架MR-SP,专门针对长视频的推理,提高了模型在处理长时间序列数据时的效率和效果。

📝重点思路

🔸构建高质量的数据集LongVideo-Reason,包括52K个问题-推理-答案对,并通过高效的自动注释管道生成数据。

🔸采用两阶段训练策略:第一阶段为长视频推理的CoT(Chain of Thought)监督微调,利用18K高质量样本;第二阶段使用强化学习,对33K长视频问答进行训练。

🔸引入序列并行技术(SP)和缓存机制,以提高长视频编码的效率并减少计算开销。

🔎分析总结

🔸实验证明LongVILA-R1模型在不同推理任务上表现优越,尤其在长视频的时序、目标和空间推理等方面,超越了诸如GPT-4o等现有模型。

🔸模型在长视频推理基准LongVideo-Reason-eval上的平均准确率达到67.9%,显示出其在处理复杂推理任务时的强大能力。

🔸强调了在没有CoT微调情况下直接进行强化学习训练会导致显著的准确率下降,证明了预训练阶段的重要性。

💡个人观点

论文的创新点在于通过多模态强化学习框架MR-SP,成功应对长视频推理中的计算挑战,并利用高质量标注的数据集有效提升模型的推理能力。

🧩附录

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)